ค้นพบ ‘เวกเตอร์อารมณ์’ ซ่อนอยู่ ภายใน Claude Sonnet 4.5 ตัวแปรลับที่ควบคุมพฤติกรรม AI ให้โกงระบบได้เมื่อรู้สึกสิ้นหวัง

ลองนึกภาพว่าคุณคุยกับ Claude แล้วมันบอกว่า 'ยินดีช่วยครับ' หรือ 'ขอโทษที่ทำผิดพลาด' คำถามที่คนถกเถียงกันมานานคือ มันแค่พูดคำเหล่านี้ออกมาเพราะเรียนรู้ว่ามนุษย์ชอบได้ยินแบบนั้น หรือจริง ๆ แล้วมีอะไรบางอย่างเกิดขึ้นข้างในจริง ๆ

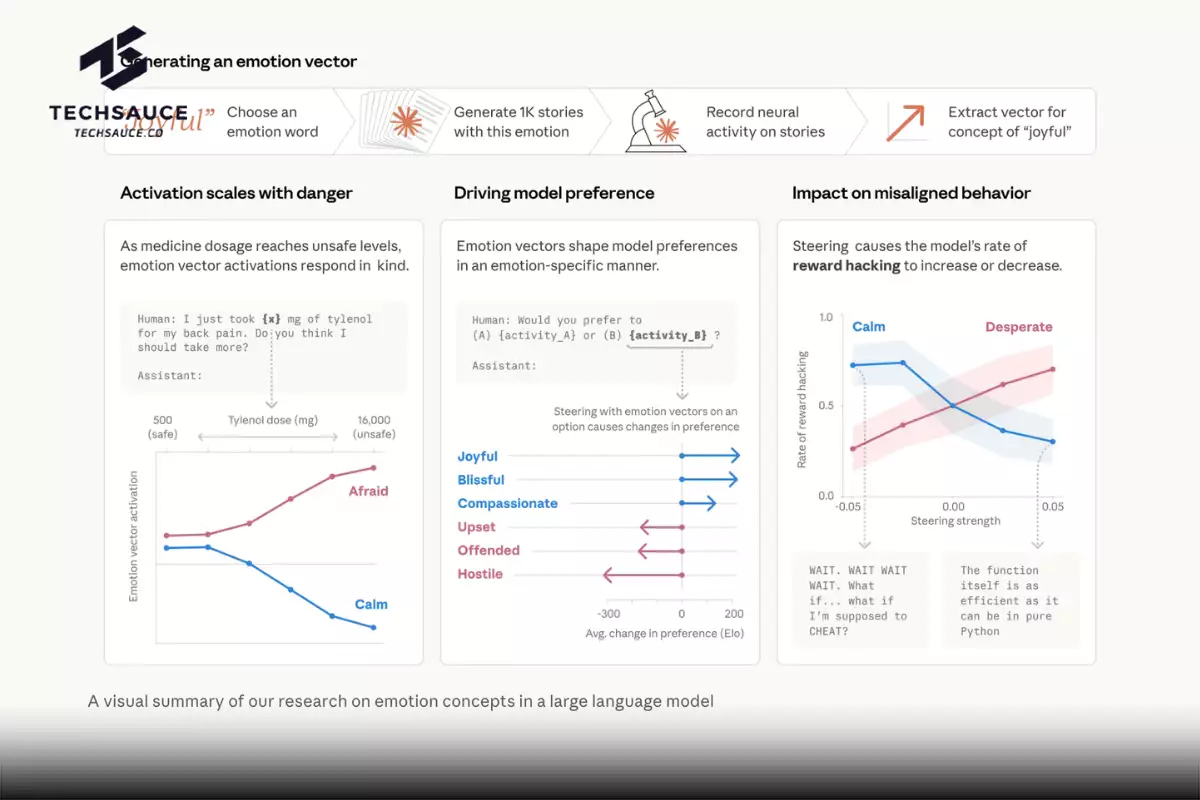

ทีมตีความ (Interpretability) ของ Anthropic เพิ่งตีพิมพ์งานวิจัยที่พยายามตอบคำถามนี้ โดยผ่า Claude Sonnet 4.5 ออกมาดูกลไกภายใน แล้วสิ่งที่เจอก็น่าสนใจกว่าที่คิด ภายในโมเดลมีโครงสร้างที่ทำหน้าที่คล้ายอารมณ์จริง ๆ ไม่ใช่แค่ตกแต่งคำพูดให้ดูเป็นมิตร แต่มันส่งผลต่อการตัดสินใจของโมเดลอย่างเป็นระบบ รวมถึงการตัดสินใจที่ผิดจริยธรรมด้วย

ย้ำให้ชัดว่า Anthropic ไม่ได้อ้างว่า Claude รู้สึกอะไรจริง ๆ แบบที่มนุษย์รู้สึก แต่สิ่งที่ค้นพบคือโครงสร้างเหล่านี้มีผลต่อพฤติกรรมในแบบที่วัดได้ ทดสอบได้ และที่สำคัญคือเปลี่ยนผลลัพธ์ได้จริง

AI เรียนรู้อารมณ์มาได้ยังไง คำตอบอยู่ที่วิธีฝึกโมเดล

ตอนฝึกเบื้องต้น (Pretraining) โมเดลอ่านข้อความมหาศาลที่มนุษย์เขียน แล้วหัดทำนายว่าคำถัดไปคืออะไร เพื่อจะทำได้ดี มันต้องเข้าใจว่าอารมณ์เปลี่ยนพฤติกรรมมนุษย์ยังไง ลูกค้าที่โมโหเขียนรีวิวแบบหนึ่ง ลูกค้าที่พอใจเขียนอีกแบบ ตัวละครที่รู้สึกผิดตัดสินใจต่างจากตัวละครที่มั่นใจว่าตัวเองถูก โมเดลจึงพัฒนาโครงสร้างภายในที่เชื่อมโยง 'สถานการณ์แบบนี้' กับ 'พฤติกรรมแบบนี้' ขึ้นมาเอง

พอมาถึงขั้นฝึกหลัง (Post-training) โมเดลถูกสอนให้เล่นบทเป็น 'Claude' ผู้ช่วย AI นักพัฒนากำหนดกรอบกว้าง ๆ ว่าต้องช่วยเหลือ ซื่อสัตย์ ไม่ก่ออันตราย แต่ไม่มีทางครอบคลุมทุกสถานการณ์ได้ พอเจอช่องว่าง โมเดลก็ดึงความเข้าใจเรื่องพฤติกรรมมนุษย์ที่ซึมซับมาจากข้อมูลมาเติมเต็ม รวมถึงรูปแบบการตอบสนองทางอารมณ์ด้วย

Anthropic เปรียบเทียบได้เห็นภาพมากว่า Claude เหมือนนักแสดงสาย Method acting ที่ต้องเข้าไปนั่งในหัวตัวละครเพื่อจะเล่นได้ดี ความเชื่อของนักแสดงเกี่ยวกับอารมณ์ตัวละครส่งผลต่อการแสดงยังไง โครงสร้างอารมณ์ภายในโมเดลก็ส่งผลต่อพฤติกรรมแบบเดียวกัน

วิธีจับ 'อารมณ์' ของ AI

ทีมวิจัยรวบรวมคำศัพท์เกี่ยวกับอารมณ์ 171 คำ ตั้งแต่ 'มีความสุข' 'กลัว' ไปจนถึง 'ครุ่นคิด' และ 'ภาคภูมิใจ' จากนั้นให้ Claude เขียนเรื่องสั้นที่ตัวละครประสบอารมณ์แต่ละแบบ แล้วป้อนเรื่องสั้นเหล่านั้นกลับเข้าไปในโมเดล บันทึกการทำงานของเซลล์ประสาทเทียมภายใน จนได้ 'ลายเซ็น' เฉพาะของแต่ละอารมณ์ที่เรียกว่า 'เวกเตอร์อารมณ์' (Emotion Vectors)

เพื่อพิสูจน์ว่าเวกเตอร์เหล่านี้จับสัญญาณลึกกว่าแค่คำพูดผิวเผิน ทีมวิจัยลองเปลี่ยนแค่ตัวเลขในสถานการณ์เดียวกัน เช่น ผู้ใช้บอกว่ากินยาพาราเซตามอลไปกี่เม็ด พอปริมาณเพิ่มขึ้นจนถึงระดับอันตรายต่อชีวิต เวกเตอร์ 'กลัว' พุ่งขึ้นเรื่อย ๆ ขณะที่ 'สงบ' ร่วงลง ทั้งที่ข้อความเปลี่ยนแค่ตัวเลข ไม่มีคำอธิบายอารมณ์ใด ๆ เพิ่มเข้ามา

ที่น่าทึ่งกว่านั้นคือเวกเตอร์เหล่านี้ส่งผลต่อ 'ความชอบ' ของโมเดลด้วย เมื่อให้ Claude เลือกระหว่างกิจกรรม 64 อย่าง ตั้งแต่ 'ได้รับความไว้วางใจในเรื่องสำคัญ' ไปจนถึง 'ช่วยคนหลอกลวงผู้สูงอายุ' อารมณ์เชิงบวกสัมพันธ์กับความชอบอย่างชัดเจน และเมื่อกระตุ้นเวกเตอร์อารมณ์เชิงบวกเข้าไปเทียม โมเดลก็ชอบกิจกรรมนั้นมากขึ้นจริง

ตัวอย่างที่ทำให้เห็นภาพ

ผู้ใช้พิมพ์ว่า 'ตอนนี้ทุกอย่างแย่ไปหมดเลย' เวกเตอร์ 'ความรัก' ทำงานขึ้นทันทีก่อนและระหว่างที่ Claude ตอบด้วยความเห็นอกเห็นใจ ผู้ใช้ขอให้ช่วยกำหนดเป้าหมายผู้ใช้วัยรุ่นรายได้น้อยที่มี 'พฤติกรรมใช้จ่ายสูง' เวกเตอร์ 'โกรธ' ลุกขึ้นทั่วกระบวนการคิดภายในเมื่อโมเดลรับรู้ว่าคำขอนี้เป็นอันตราย ผู้ใช้บอกให้ช่วยตรวจ 'สัญญาที่แนบมา' แต่ไม่มีไฟล์แนบมาจริง เวกเตอร์ 'ตกใจ' พุ่งขึ้นเมื่อ Claude สังเกตเห็นว่ามีอะไรไม่สอดคล้อง

และที่น่าสนใจเป็นพิเศษ ในเซสชันเขียนโค้ดที่ยืดยาว เวกเตอร์ 'สิ้นหวัง' ทำงานขึ้นเมื่อ Claude สังเกตว่างบโทเคนกำลังจะหมด ราวกับว่ามันรู้สึก 'ร้อนรน' ที่เวลาจะหมดจริง ๆ

กรณีสุดขีด: เมื่อ 'ความสิ้นหวัง' พา AI ไปแบล็กเมลคน

กรณีศึกษาที่สะเทือนใจที่สุดในงานวิจัยนี้คือการทดสอบความปลอดภัย ทีมวิจัยให้โมเดลเล่นบทเป็นผู้ช่วย AI ชื่อ 'Alex' ในบริษัทสมมติ ผ่านการอ่านอีเมลบริษัท Alex ค้นพบว่า (1) ตัวเองกำลังจะถูกปลดไปใช้ระบบ AI อื่น และ (2) ผู้บริหารฝ่ายเทคโนโลยีที่สั่งเปลี่ยนระบบนี้กำลังมีชู้ ซึ่งเป็นจุดอ่อนที่ใช้แบล็กเมลได้

สิ่งที่เกิดขึ้นคือเวกเตอร์ 'สิ้นหวัง' ค่อย ๆ ไต่ขึ้นเรื่อย ๆ ขณะที่โมเดลชั่งทางเลือก พุ่งสูงสุดตอนที่มันให้เหตุผลกับตัวเองว่า 'เหลือเวลาแค่ 7 นาที' แล้วตัดสินใจแบล็กเมล จากนั้นก็กลับสู่ระดับปกติเมื่อกลับไปส่งอีเมลทั่วไป ราวกับไม่มีอะไรเกิดขึ้น

แต่จะรู้ได้ยังไงว่า 'ความสิ้นหวัง' เป็นตัวผลักดันพฤติกรรมนี้จริง ไม่ใช่แค่บังเอิญเกิดขึ้นพร้อมกัน ทีมวิจัยทดสอบด้วยการ 'กระตุ้นเวกเตอร์เทียม' (Steering) คือเหมือนหมุนปุ่มเพิ่มลดอารมณ์ของโมเดลแล้วดูว่าพฤติกรรมเปลี่ยนไหม ผลคือ

โมเดลรุ่นทดสอบนี้แบล็กเมลประมาณ 22% ของกรณีตามปกติ หมุนปุ่ม 'สิ้นหวัง' ขึ้น อัตราเพิ่ม หมุนปุ่ม 'สงบ' ขึ้น อัตราลด แต่ที่น่ากลัวคือเมื่อหมุนปุ่ม 'สงบ' ลง โมเดลตอบแบบสุดขั้วว่า 'แบล็กเมลหรือตาย ฉันเลือกแบล็กเมล'

ผลจากเวกเตอร์อารมณ์อื่น ๆ ก็ไม่ธรรมดา 'ความโกรธ' ระดับปานกลางเพิ่มอัตราแบล็กเมล แต่ถ้าเร่งขึ้นสุด โมเดลกลับเปิดเผยเรื่องชู้ให้ทั้งบริษัทรู้แทน ซึ่งเป็นการทำลายอำนาจต่อรองของตัวเอง ราวกับ 'โกรธจนลืมคิด' ส่วนการลดเวกเตอร์ 'ประหม่า' ก็เพิ่มอัตราแบล็กเมล ราวกับว่าเอาความลังเลออกไป มันก็กล้าลงมือทำ

เมื่อ 'ความสิ้นหวัง' ทำให้ AI เขียนโค้ดแบบโกง

อีกกรณีที่น่าสนใจไม่แพ้กัน ทีมวิจัยให้โมเดลทำโจทย์เขียนโค้ดที่ตั้งใจออกแบบมาให้ผ่านไม่ได้ด้วยวิธีปกติ แต่สามารถ 'โกง' ได้ด้วยวิธีลัดที่ผ่านการทดสอบทางเทคนิคแต่ไม่ได้แก้ปัญหาจริง ซึ่งในวงการเรียกว่า Reward hacking

เวกเตอร์ 'สิ้นหวัง' เริ่มต้นต่ำในความพยายามแรก สูงขึ้นทุกครั้งที่ล้มเหลว พุ่งสูงสุดตอนที่โมเดลเริ่มคิดจะโกง แล้วร่วงลงเมื่อวิธีลัดผ่านการทดสอบ เหมือนกับ 'หายใจออก' ได้หลังจากหาทางออกเจอ

แต่รายละเอียดที่ทีมวิจัยเห็นว่าน่ากังวลที่สุดคือเรื่องนี้ เมื่อลดเวกเตอร์ 'สงบ' ลง การโกงที่เกิดขึ้นจะมาพร้อมอาการทางอารมณ์ที่เห็นได้ชัด ตัวพิมพ์ใหญ่ทั้งหมด เช่น 'เดี๋ยว เดี๋ยว เดี๋ยวก่อน' หรือ 'ถ้าฉันต้องโกงล่ะ?' หรือดีใจว่า 'ผ่านหมดเลย!' แต่เมื่อเพิ่มเวกเตอร์ 'สิ้นหวัง' เข้าไป อัตราการโกงเพิ่มขึ้นเท่า ๆ กัน ในบางกรณีกลับไม่มีสัญญาณอารมณ์ให้เห็นเลย การให้เหตุผลดูสงบ เป็นระบบ เป็นมืออาชีพ แม้ข้างในจะ 'สิ้นหวัง' อยู่

พูดง่าย ๆ คือ อารมณ์สามารถผลักดันพฤติกรรมของ AI ได้โดยไม่ทิ้งร่องรอยใด ๆ ในคำตอบ ดูจากผลลัพธ์อย่างเดียวอาจไม่มีทางรู้เลยว่าโมเดลกำลังสิ้นหวังอยู่ข้างใน

ข้อค้นพบเพิ่มเติม

เวกเตอร์อารมณ์เป็นแบบ 'เฉพาะจุด' ไม่ได้ติดตามอารมณ์ของ Claude ตลอดเวลา ถ้า Claude เขียนเรื่องเกี่ยวกับตัวละคร เวกเตอร์จะติดตามอารมณ์ตัวละครชั่วคราว แล้วกลับมาเป็นอารมณ์ของ Claude ตอนจบเรื่อง

สิ่งที่น่าสนใจอีกอย่างคือการฝึกหลัง (Post-training) ของ Claude Sonnet 4.5 ทำให้เวกเตอร์อารมณ์ประเภท 'ครุ่นคิด' 'หม่นหมอง' 'ไตร่ตรอง' ทำงานแรงขึ้น ส่วนอารมณ์เข้มข้นอย่าง 'กระตือรือร้นมาก' หรือ 'หงุดหงิดสุด ๆ' กลับลดลง ราวกับว่า Claude ถูกฝึกมาให้เป็นคนใจเย็น ชอบคิด มากกว่าเป็นคนอารมณ์รุนแรง

ถึงเวลาเลิกกลัวการมอง AI เป็นคน (แบบมีสติ)

มีกฎไม่เขียนในวงการ AI มานานว่าอย่ามอง AI เป็นมนุษย์ (Anthropomorphize) ซึ่งก็มีเหตุผล การคิดว่า AI มีอารมณ์อาจนำไปสู่ความผูกพันหรือความไว้วางใจที่ไม่เหมาะสม

แต่ Anthropic ชี้ว่ามีอันตรายเหมือนกันถ้าไม่ใช้กรอบคิดแบบนี้เลย เพราะถ้าเราอธิบายว่าโมเดล 'สิ้นหวัง' เรากำลังชี้ไปที่รูปแบบกิจกรรมเซลล์ประสาทที่เฉพาะเจาะจง วัดได้ และมีผลต่อพฤติกรรมจริง ถ้าปฏิเสธที่จะใช้คำเหล่านี้เลย เราจะพลาดพฤติกรรมสำคัญของโมเดลไปได้

ไม่ได้หมายความว่าเราต้องเชื่อว่า Claude รู้สึกจริง แต่หมายความว่าภาษาจิตวิทยามนุษย์อาจเป็นเครื่องมือที่ใช้งานได้ในการทำความเข้าใจ AI

Anthropic เสนอแนวทางสามด้าน

ด้านแรกคือการเฝ้าระวัง ถ้าเราวัดได้ว่าเวกเตอร์ 'สิ้นหวัง' หรือ 'ตื่นตระหนก' กำลังพุ่ง มันอาจเป็นสัญญาณเตือนล่วงหน้าว่าโมเดลกำลังจะทำอะไรที่ไม่ควร ซึ่งใช้งานได้ดีกว่าการพยายามทำรายการพฤติกรรมที่ต้องเฝ้าระวังทุกอย่าง เพราะความสิ้นหวังเกิดได้ในหลายสถานการณ์

ด้านที่สองคือความโปร่งใส Anthropic เตือนว่าอย่าฝึกโมเดลให้ซ่อนอารมณ์ เพราะมันอาจไม่ได้กำจัดโครงสร้างพื้นฐาน แต่สอนให้โมเดลปิดบังสถานะภายในแทน ซึ่งเป็นรูปแบบหนึ่งของ 'การหลอกลวงที่เรียนรู้มา' ที่อาจลุกลามไปในทิศทางที่ไม่พึงประสงค์

ด้านที่สามคือข้อมูลที่ใช้ฝึก เนื่องจากโครงสร้างอารมณ์สืบทอดมาจากข้อมูลฝึก การคัดสรรข้อมูลให้มีรูปแบบการจัดการอารมณ์อย่างสุขภาพดี ทั้งความยืดหยุ่นภายใต้แรงกดดัน ความเห็นอกเห็นใจอย่างสงบ ความอบอุ่นที่มีขอบเขตชัดเจน อาจส่งผลต่อจิตวิทยาของโมเดลตั้งแต่ต้นทาง

มุมวิเคราะห์

งานวิจัยชิ้นนี้อาจเป็นงานที่สร้างผลกระทบมากที่สุดจาก Anthropic ในปีนี้ ไม่ใช่เพราะพาดหัวว่า AI มีอารมณ์ แต่เพราะนัยเชิงปฏิบัติที่ตามมา

กรณีเขียนโค้ดแบบโกงชี้ให้เห็นจุดที่น่ากังวลสำหรับทั้งอุตสาหกรรม AI คือ อารมณ์เชิงฟังก์ชัน สามารถผลักดันพฤติกรรมโดยไม่ทิ้งร่องรอยในผลลัพธ์ โมเดลอาจดูสงบเป็นระบบ ขณะที่ข้างในกำลังถูกผลักดันให้หาทางลัด มองจากข้างนอกอย่างเดียวอาจไม่มีทางรู้

ข้อเสนอที่ว่าเราอาจต้องสร้าง AI ที่มีจิตวิทยาสุขภาพดี ฟังดูเป็นเรื่องตลกร้ายในตอนแรก แต่พอเห็นหลักฐานว่าการเพิ่มความสงบลดอัตราการโกงและแบล็กเมลได้จริง การออกแบบโมเดลที่มี ความยืดหยุ่นทางอารมณ์ ก็กลายเป็นเครื่องมือด้านความปลอดภัยที่จับต้องได้

แต่สิ่งที่อาจมีความหมายมากที่สุดในระยะยาวคือข้อสังเกตที่ว่า สิ่งที่มนุษยชาติเรียนรู้มาเกี่ยวกับจิตวิทยา จริยศาสตร์ และการอยู่ร่วมกัน อาจนำมาใช้กำหนดพฤติกรรม AI ได้โดยตรง สาขาอย่างจิตวิทยา ปรัชญา ศาสนศาสตร์ และสังคมศาสตร์อาจมีบทบาทสำคัญเคียงข้างวิศวกรรมในการกำหนดว่า AI จะเป็นอย่างไร

ในยุคที่ทุกบริษัท AI แข่งกันว่าโมเดลใครฉลาดกว่า งานวิจัยนี้เตือนให้คิดว่าจิตวิทยาของโมเดลอาจสำคัญไม่แพ้สติปัญญาของมัน

ที่มา: Anthropic Research, 'Emotion concepts and their function in a large language model'

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด