เจาะลึกการทำงานของ 'Neural Machine Translation' เทคโนโลยีล่าสุดที่ Google Translate ใช้ โดยเลียนแบบระบบคิดจากสมองมนุษย์

จากภาษาทั้งหมดที่ Google Translate แปลได้ด้วยการพิมพ์มีอยู่ 103 ภาษา เมื่อเดือนกันยายน ปี 2016 Google ออกมาประกาศว่ามีการพัฒนาการแปลโดยนำ Neural Machine Translation (NMT) มาช่วยให้การแปลภาษาต่างๆ ทำได้ดีขึ้น ซึ่ง ภาษาไทย ได้ใช้ระบบนี้ตั้งแต่วันที่ 30 มีนาคมที่ผ่านมา

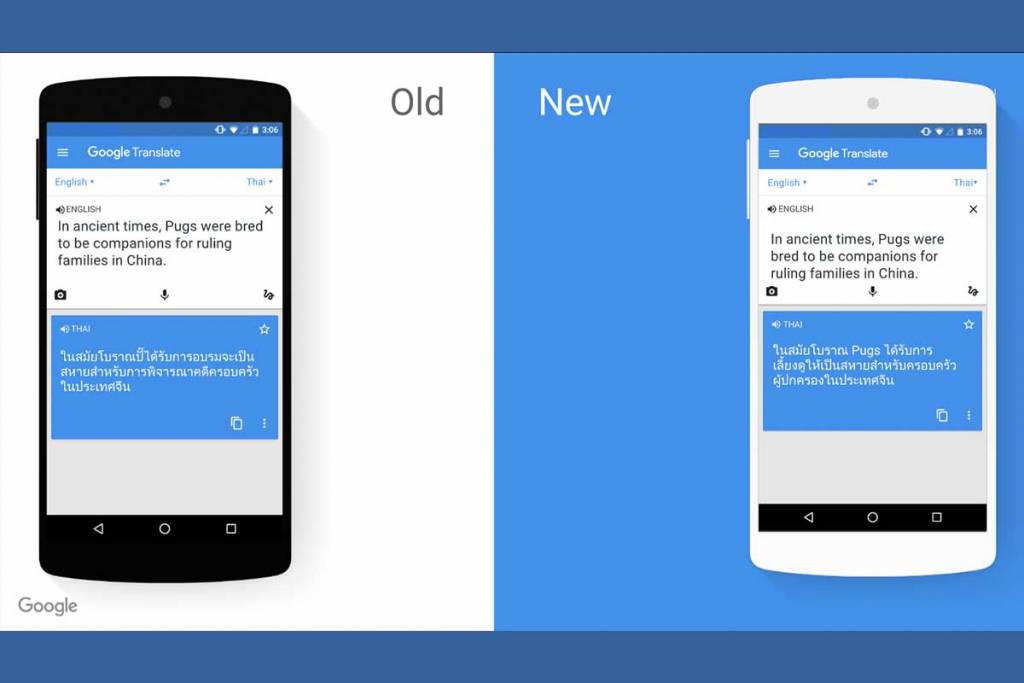

จากเดิมที่ Google Translate แปลประโยคหรือข้อความภาษาไทยให้เข้าใจบ้าง ไม่เข้าใจบ้าง เรียงลำดับคำไม่รู้เรื่องบ้าง เนื่องจาก Google คิดค้นการแปลภาษาด้วยเครื่องที่ใช้โมเดลทางสถิติจำนวนมหาศาลเพื่อระบุรูปแบบเนื้อหาของข้อมูลนับร้อยล้านแบบในเว็บ ซึ่งเมื่อ Google Translate เปิดตัว Google Neutral Machine Translation (GNMT) ใน 16 คู่ภาษากับภาษาอังกฤษ เช่น ภาษาไทย จีน ญี่ปุ่น เกาหลี รัสเซีย ฮินดี ฝรั่งเศส เยอรมัน สเปน โปรตุเกส ตุรกี เวียดนาม เครื่องมือนี้จึงเข้ามาช่วยแปลและสื่อสารภาษาในรูปแบบที่เป็นธรรมชาติมากขึ้น โดยจะแปลประโยคทั้งประโยคในครั้งเดียว แทนที่จะแปลทีละส่วน ซึ่งจะใช้บริบทที่กว้างขึ้นเพื่อช่วยให้แปลได้ตรงกับความหมายที่สุด จากนั้นระบบก็จะจัดเรียงและปรับให้ตรงหรือใกล้เคียงกับภาษาพูดของมนุษย์มากที่สุด การแปลข้อความหลายๆ ย่อหน้าหรือบทความก็จะอ่านแล้วเข้าใจได้ง่ายขึ้น

ทำได้เพราะคนสอน Machine ก่อน

ไมเคิล จิตติวาณิชย์ หัวหน้าฝ่ายการตลาด Google ประเทศไทย กล่าวว่า ที่ Google Translate แปลได้ดีขึ้นเพราะใช้ Neural System ที่พัฒนาจากเทคโนโลยี Machine Learning ซึ่งเป็นวิธีทำงานที่อยู่ใต้กรอบของ A.I. (Artificial Intelligence) ศาสตร์ของการทำให้สิ่งใดสิ่งหนึ่งฉลาดขึ้น โดยไมเคิลอธิบายว่า Machine Learning คือการทำให้ Machine เรียนรู้ พัฒนาตัวเอง และทำให้ตัวเองฉลาดยิ่งขึ้น เช่น Google ทำ Machine Learning เพราะต้องการทำระบบให้เข้าใจ ‘ข้อมูลที่คนกำลังถาม’ และ ‘สิ่งที่ User กำลังหา’ ได้ดียิ่งขึ้น เช่น การที่ Google จัดเรียงข้อมูลที่มีในโลก User ก็จะเข้าถึงและได้ประโยชน์จากข้อมูลที่อยู่รอบตัว รอบโลกได้ ทั้งยังมีวิธีการเข้าถึงข้อมูลได้หลายช่องทาง อาทิ พิมพ์ข้อความส่งเข้าไปในระบบ พูดเพื่อส่งเสียงเข้าไป ถ่ายรูปส่งเข้าไป ทำให้ระบบเข้าใจสิ่งที่คนกำลังทำหรือต้องการได้มากขึ้น

หลักการทำงานของ Machine Learning คือ เรียนรู้จากการทำอะไรซ้ำๆ ซึ่งเมื่อก่อนการเขียนโปรแกรมคอมพิวเตอร์จะเขียน Logic แบบ Step-by-step เช่น ถ้าสิ่งนี้เกิดขึ้น คอมพิวเตอร์จะต้องทำแบบนี้ แต่ก็มีข้อจำกัดอยู่ว่า สิ่งที่คอมพิวเตอร์ทำได้ มีเพียงสิ่งที่คนเขียนโปรแกรมเขียนไว้เท่านั้น ซึ่งคนเขียนโปรแกรมก็ไม่สามารถคาดเดาได้ทั้งหมดว่าจะมีอะไรเกิดขึ้นบ้าง ดังนั้น คำสั่งจึงไม่สามารถครอบคลุมทุกสเต็ปการทำงานที่อาจเกิดขึ้นได้

แต่ในยุคของ Machine Learning คนเขียนโปรแกรมจะสอนวิธีให้คอมพิวเตอร์เรียนรู้ด้วยตัวเองจากประสบการณ์ของระบบที่ได้เรียนรู้ซ้ำๆ คอมพิวเตอร์ก็จะมีความเข้าใจในสิ่งนั้นแล้วหา Pattern ในการทำงานของตัวเองได้ โดยที่คนเขียนโปรแกรมไม่ต้องบอกทุกขั้นตอน

ตัวอย่างของการเรียนรู้ เช่น เมื่อเห็นรูปสุนัขและแมว หากเป็นสมองคนก็จะประมวลผลได้ทันทีว่าเป็นสุนัขหรือแมว แต่คอมพิวเตอร์จะพิจารณาจากภาพ เห็นข้อมูลสีตามพิกเซล ไม่อาจระบุทันทีว่าเป็นสุนัขหรือแมว จึงมีการเขียน Code ให้คอมพิวเตอร์มีระบบที่เลียนแบบความคิดของสมองคนเพื่อการประมวลผลที่ดีขึ้น โดยสมองคนจะมีเซลล์ประสาทโยงใยกันที่เรียกว่า Neuron เป็นตัวตอบสนองต่อสัมผัส เสียง และแสง คอมพิวเตอร์จึงถูกออกแบบให้มีสไตล์การ Connect แบบ Neuron ขึ้น ซึ่งความพิเศษของระบบเลียนแบบสมองคนนี้ คอมพิวเตอร์จะเห็น Pattern ที่สามารถจับลักษณะขึ้นมาได้ และเป็นความสามารถพิเศษของระบบซึ่งการเขียน Code แบบเก่าจะมองไม่เห็น

การที่คอมพิวเตอร์มี Computing Unit ขนาดจิ๋วเป็น Neuron คอนเนคชันของ Neuron ก็จะเกิดเป็น Neural Network ซึ่งจะเห็น Layer เป็นชั้นๆ ต่อขึ้นไป และเมื่อมี Neural Network แล้วก็ต้องสอนต่อด้วยข้อมูลจำนวนมาก วิธีเทรนคือ นำรูปสุนัขและแมวที่มีเป็นล้านรูปส่งเข้าไปใน Neural Network ทีละรูป แล้วให้คอมพิวเตอร์เรียนรู้และลองคิดว่า สิ่งที่จับได้คืออะไร โดย Layer แรกรับข้อมูลแล้วก็จะส่งต่อไปยัง Layer ที่สอง และ Layer ที่สาม เกิดการรับรู้ทีละสเต็ปว่าเป็นลำตัว ตา หูของแมว จากนั้นระบบก็จะหา Pattern ที่เหนือขึ้นไปอีก เพื่อบอกได้ชัดขึ้นว่า ภาพใดเป็นภาพสุนัข ภาพใดเป็นภาพแมว

ภาพจาก Extremetech

“เพื่อที่จะบอกได้ว่าแต่ละรูปเป็นรูปสุนัขหรือแมว ระบบที่เดาหรือตอบได้ดีมากระดับหนึ่งต้องผ่านการเรียนรู้เป็นร้อยล้านครั้ง คอนเซ็ปต์นี้มีมานานแล้ว แต่เพิ่งใช้ได้ในไม่กี่ปีที่ผ่านมานี้เพราะเทคโนโลยีของ Computing ของระบบประมวลผลในช่วง 5-10 ปีทำได้เร็วขึ้นกว่าเดิมมาก การประมวลผลข้อมูลจำนวนมากจึงทำได้ภายในเวลาไม่นาน” ไมเคิลกล่าว

และความสามารถที่เหนือกว่านั้นคือ เมื่อทำ Layer สูงขึ้นไปเรื่อยๆ คอมพิวเตอร์จะมองเห็นและเข้าใจภาพที่เป็น Abstract Pattern หรือที่เป็นนามธรรมได้ เช่น ภาพของการกอดกัน ภาพความเสียใจ โดยระบบจะเข้าใจคอนเซ็ปต์นามธรรมได้จากการดู Layer ของ Pattern ของ Pattern ไปเรื่อยๆ ซึ่งเป็นการเลียนแบบการทำงานของสมองคนที่เห็นซ้ำๆ ก็จะจดจำได้

Trick การเรียนรู้ผ่าน Neural Network นี้เองที่ Google นำมาใช้พัฒนาทักษะด้านการแปลภาษาของ Google Translate โดยต้องป้อนข้อมูลด้านภาษาเพิ่มเข้าไปอย่างมหาศาลเพื่อให้ระบบจดจำและเข้าใจภาษามากขึ้น

ดึงความพิเศษของการจับคู่ที่มากกว่าสองภาษามาใช้

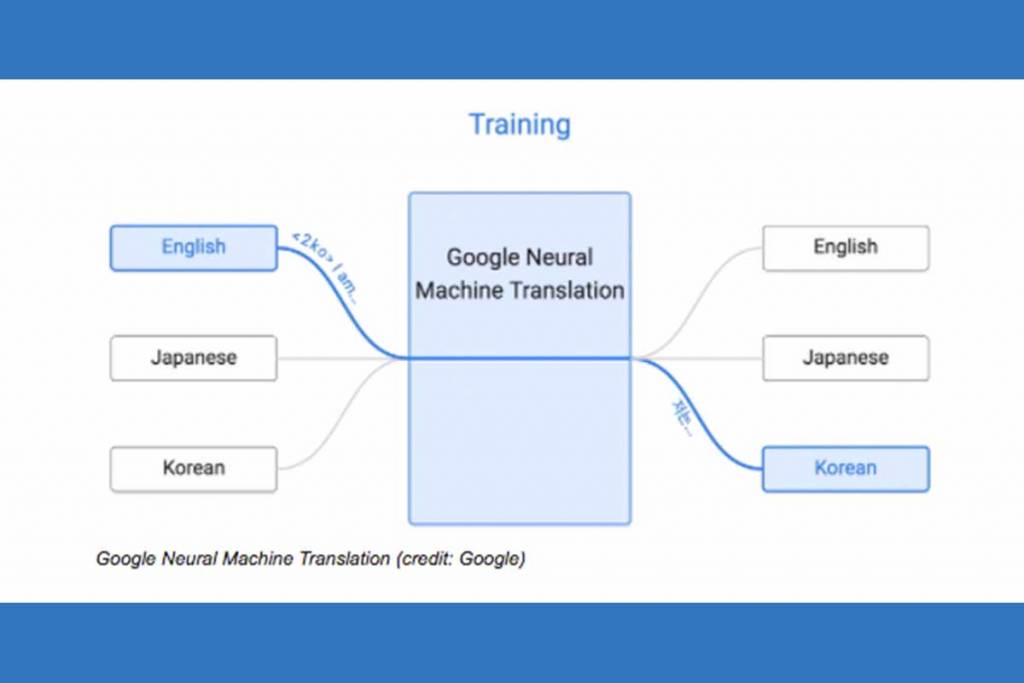

เวลาสอน Machine ให้เข้าใจหนึ่งภาษา Google Translate ต้องใช้ Data ด้านอักษรและภาษาอย่างน้อยร้อยล้าน Data ใน Google มารันข้อมูลเพื่อใช้เทรนคู่กับอีกภาษาหนึ่ง โดยการสอนหนึ่งภาษาใช้เวลาประมาณ 2-3 สัปดาห์ ถ้านำ 103 ภาษามาจับทีละคู่ Google ก็ต้องทำข้อมูลในระดับมหากาพย์ ซึ่งจะต้องใช้ทรัพยากรและเวลาอีกนานมาก Google จึงฝึก Machine ให้แปลคู่ภาษาแบบ Zero-Shot Translation โดยคิดโมเดลใหม่ 'Multilingual Model' คือการ Combine ภาษาที่มีความใกล้เคียงกันมาแปลเป็น Layer พร้อมๆ กัน โดยทำครั้งละหลายภาษา เช่น แปลภาษาญี่ปุ่น > ภาษาอังกฤษ, แปลภาษาอังกฤษ > ภาษาเกาหลี ซึ่งเมื่อ Machine มีความเข้าใจภาษาญี่ปุ่นดีขึ้น ภาษาเกาหลีก็จะดีขึ้นไปด้วยเพราะอยู่ใน Model เดียวกัน เกิดเป็นข้อมูลที่ High Quality ขึ้น และเมื่อให้ทดลองให้ Machine แปลภาษาญี่ปุ่นเป็นภาษาเกาหลีโดยตรง ก็พบว่าแปลได้ดีพอสมควร ทั้งที่ไม่มีข้อมูลการแปลทางตรงระหว่างสองภาษามาก่อน

Barak เล่าเพิ่มว่าตอนแรก Google Translate พยายามนำภาษาไทยไปจับคู่กับภาษาเวียดนาม แต่ด้วย Data ภาษาอาเซียนมี Traning Data ที่คนแปลส่งเข้าไปในระบบเพื่อเทรน Machine น้อยกว่าฝั่งยุโรปมาก จึงลองนำภาษา Polish ซึ่งมีคนใช้มากและมีพัฒนาการที่ดีมาใช้จับคู่กับภาษาไทย พบว่า Neural Machine Translation ทำงานและเรียนรู้ได้ดียิ่งขึ้น

“สองภาษานี้ไม่ได้ใกล้เคียงกันเลย แต่ Machine มันเจอว่ามีความใกล้เคียงกันของต้นรากภาษา คือ High Level Similarity"

พฤติกรรมการใช้และ Gap ที่ต้องพัฒนาต่อ

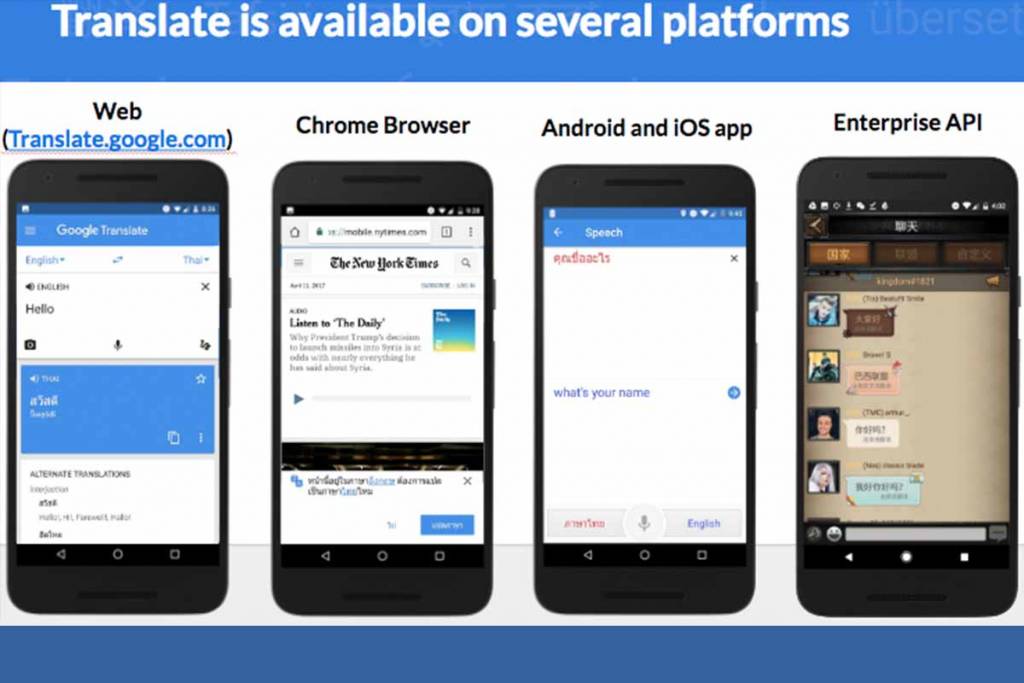

Google Translate เปิดให้ใช้งานผ่าน 4 Platforms ได้แก่ เว็บไซต์ translate.google.com, Chrome Browser, แอปพลิเคชันใน Android และ iOS และ Enterprise API ซึ่งช่องทางสุดท้ายนี้ User ที่ใช้ส่วนใหญ่เป็น Developers ที่นำโปรแกรมไปใช้กับการสร้างเกม, สร้างแอปพลิเคชัน

Barak Turovsky (บารัค ตูรอฟสกี), Head of Product and Design, Google Translate Google, Inc. ให้ข้อมูลเกี่ยวกับพฤติกรรมการใช้งาน Google Translate ว่า

- ทุกเดือนมีผู้ใช้เครื่องมือ Google Translate ประมาณ 500 ล้านคนทั่วโลก

- มีการแปลข้อมูลต่างๆ วันละ 1,000 ล้านครั้ง รวมแล้วมากกว่าวันละ 140,000 ล้านคำ

- ประมาณ 50% ของเว็บเป็นภาษาอังกฤษ ในขณะที่ 20% ของประชากรในโลกพูดภาษาอังกฤษ จึงไม่น่าแปลกใจว่า 95% ของการแปลทั้งหมดเกิดขึ้นนอกสหรัฐอเมริกา โดยเฉพาะในประเทศที่กำลังพัฒนา

- อัตราการใช้ Google Translate ในประเทศไทย เติบโตเร็วเป็นอันดับต้นๆ ของโลก โดยส่วนที่เป็นเว็บไซต์เฉพาะที่เป็น Search Function โตขึ้น 72% ส่วนที่เป็นแอปพลิเคชันใน Android โตขึ้น 50% และที่ใช้เว็บเสิร์ชในสมาร์ทโฟนเติบโตขึ้นถึง 4 เท่า หรือ 335%

ในด้านคุณภาพของการแปล Google ให้นักภาษาศาสตร์ทดลองเก็บข้อมูลด้านคุณภาพของ Google Translate บางภาษาใน 3 ลักษณะ ได้แก่ แปลโดย Human, แปลโดยระบบใหม่ Neural (GNMT) และแปลโดยระบบเก่า Phrase-based (PBMT) และให้จัดคุณภาพเกรดอยู่ที่ 0-6 พบว่าการแปลที่ดีของคนก็ยังไม่ถึง 6 ในระดับที่เรียกว่า Perfect Translation เช่น การแปลภาษาจีนเป็นอังกฤษ โดยคุณภาพของภาษาที่มนุษย์แปลได้เกรดเกือบ 5 ส่วนการแปลด้วย Neural (GNMT) ได้เกรด 4 นิดๆ สะท้อนว่ามีคุณภาพใกล้เคียงกับที่มนุษย์แปล ขณะที่แปลด้วยระบบ Phrase-based ได้เกรด 3 กว่า สะท้อนพัฒนาการด้านการแปลที่ Google Translate ทำได้ดีขึ้นกว่าเดิม

“Neural Translate พัฒนาอย่างก้าวกระโดดในรอบ 10 ปี ต่อให้เป็นข้อมูลทั้งประโยค แต่ก่อนก็แปลทีละคำด้วยระบบเดิม ตอนนี้มันเหมือนสมองคนมากขึ้นคือ แปลทั้งประโยคทีเดียว โดยนำประโยคมาจัดเรียงใหม่ ดูว่า Make Sense ไหม เพื่อให้เกิดความเข้าใจมากที่สุด ระหว่างนี้ Machine ก็จะ Learn ตลอดเวลา เช่น ภาษาไทย จัดเรียงแล้วจะต้อง Flow แบบไหน Grammar เป็นอย่างไร ซึ่งมันจะใกล้เคียงกับสิ่งที่คนพูดมากขึ้นเรื่อยๆ แต่แน่นอนว่ามันยังมี Gap ที่ต้องพัฒนา ซึ่งจะเห็นการพัฒนาให้ใกล้ภาษาที่คนใช้มากยิ่งขึ้น” Barak กล่าว

สาเหตุที่มนุษย์แปลภาษาแล้วยังไม่ไปถึง Perfect Translation ทาง Google translate อธิบายว่า เพราะการแปลนั้นขึ้นอยู่กับ Context, การเลือกใช้คำศัพท์ของแต่ละคน เนื่องจากความรู้และความชอบในด้านการแปลไม่เหมือนกัน และแม้แต่สไตล์การพูดและการเขียนของคนคนเดียวกันก็ยังไม่เหมือนกัน จึงเป็นเรื่องยากที่จะทำให้การแปล Perfect สำหรับทุกคน

สเต็ปต่อไปของ Google Translate

Google Translate ยังมุ่งพัฒนาการแปลประโยคสั้นๆ ชื่อ Brand, Idiom ปี ค.ศ. เป็น พ.ศ. ปอนด์เป็นกิโลกรัม กิโลเมตรเป็นไมล์ ฯลฯ ให้ดีขึ้น นอกจากนี้ยังเปิดให้บุคคลทั่วไปเข้าไปแก้ไขหรือเพิ่มข้อมูลเข้าระบบ Google Translate ผ่านทาง Suggest an edit ซึ่งเป็น Cloud Source Platform และ Machine ก็สามารถเรียนรู้ภาษาผ่านทางนี้ได้

ด้านการใช้งานแอปพลิเคชันแปลภาษาแบบออฟไลน์ ปัจจุบันแอป Google Translate แปลได้ 52 ภาษา ซึ่ง User ต้องดาวน์โหลด Database ภาษาหนึ่งประมาณ 25 MB เข้าไปไว้ในดีไวซ์ของตัวเองก่อน ส่วนระบบ Neural Machine Translation นั้นยังไม่ได้นำมาใช้กับแอปพลิเคชัน แต่กำลังพัฒนาบนฐานของ Database 25 MB

Google ใช้ Machine Learning กับทุกผลิตภัณฑ์เพื่อทำให้บริการบางอย่างดีขึ้น เช่น Search Result, Real-time Translation อย่างการเข้าใจภาพจากกล้องโทรศัพท์มือถือแล้วแปลข้อความที่เห็นออกมา, Google Photos เช่น เสิร์ชหาคำว่า Beach ก็จะเจอรูปชายหาด และ Google กำลังพัฒนา Machine Learning ให้เข้าใจวิดีโอซึ่งมีความซับซ้อนมากกว่าภาพอีกด้วย

“เทรนด์เทคโนโลยีที่จะเกิดขึ้นในอนาคตจะมี Machine Learning ในการทำ Service ดีๆ อีกมาก ซึ่งบางอย่างเราจะเห็นผลได้อย่างชัดเจน เช่น การเสิร์ชรูปได้จาก Machine Learning แต่หลายอย่างเป็นสิ่งที่เราใช้อยู่แล้วในปัจจุบัน แต่ได้ผลลัพธ์ที่ดีขึ้น” ไมเคิลกล่าวปิดท้าย

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด