AI x Humanity ทางแยกสุดท้ายของมนุษย์ เมื่อ AI ฉลาดขึ้นแต่คนอาจโง่ลง?

จากงาน AI x Humanity: Redefining Work, Organization and Future of Intelligence จัดโดย House of Wisdom ร่วมกับ Harvard Business School (HBS) Association of Thailand ที่ผ่านมา เป็นการรวมตัวของผู้นำทางความคิดอย่าง คุณกระทิง พูนผล, คุณอโณทัย เวทยากร (MD, IBM Thailand), และ ดร.แพท ปัทรณุฏพร Assistant Professor of Media Arts and Sciences

สิ่งที่คุยกันคืนนั้นไม่ใช่เรื่องอนาคตของ AI แต่เป็นเรื่องที่ปฏิบัติได้จริงวันนี้เลย ว่าองค์กรควรเริ่มต้นยังไง ควรระวังอะไร และคำถามที่ลึกกว่านั้นคือ ในยุคที่ทุกคนแข่งกันสร้าง AI ให้ฉลาดขึ้น เราจะมั่นใจได้ยังไงว่ามนุษย์จะไม่โง่ลง

ความฉลาดของ AI อยู่ขั้นไหนในปัจจุบัน

เริ่มต้นที่คุณอโณทัย โดยให้ข้อมูลว่า ในปัจจุบันอัตราการใช้ AI ในองค์กรไทยอยู่ที่ประมาณ 4% และคาดว่าจะเพิ่มเป็น 7% ในปีถัดไป คุณอโณทัยเน้นย้ำว่า AI ไม่ใช่แค่ทางเลือก แต่เป็นทางรอดของธุรกิจ โดยเปรียบเทียบว่าหากคู่แข่งใช้ AI เพิ่มประสิทธิภาพและลดต้นทุนได้ถึง 30-40% องค์กรที่ไม่ปรับตัวจะสูญเสียความสามารถในการแข่งขันทันที

นอกจากนี้คุณอโณทัยก็เสริมให้เห็นภาพที่กว้างขึ้นว่า ถ้าเทียบความสามารถของ AI ตามการศึกษาของ Gartner แบ่งวิวัฒนาการของ AI ไว้ 5 ขั้น ตอนนี้โลกอยู่ที่ขั้นที่ 3 ซึ่งเป็นยุคของ Agentic AI ที่ระบบเริ่มทำงานแบบกึ่งอัตโนมัติได้แล้ว วางแผน ตัดสินใจ และดำเนินการได้เองในบางขั้นตอน โดยยังมีมนุษย์คอยดูแลอยู่ในลูป

ขั้นที่ 4 และ 5 คือ Fully Agentic ที่ระบบรัน workflow ทั้งหมดเองโดยไม่ต้องมีคนอยู่ในกระบวนการเลย ฟังดูน่าตื่นเต้น แต่คุณอโณทัยชี้ว่าตอนนี้ความเสี่ยงกับผลตอบแทนยังไม่คุ้มกัน เพราะองค์กรที่ทดลองปล่อยให้ AI ตัดสินใจและรัน Workflow ทั้งหมดเองพบว่าเมื่อเกิดปัญหาขึ้นมันเกิดเร็วและแก้ยากกว่าที่คิดมาก

สาเหตุที่ยังต้องการมนุษย์อยู่ไม่ใช่แค่เรื่องความปลอดภัย แต่เป็นเรื่องธรรมชาติของ AI เพราะมันเก่งมากในการบอกว่าอะไรเป็นไปได้ มันสร้างทางเลือก สร้างคำตอบ สร้าง scenario ได้ดีกว่ามนุษย์ในหลายมิติ แต่สิ่งที่ AI ทำไม่ได้คือบอกว่าเราควรทำอะไร เพราะนั่นต้องการ Judgment ที่มาจากบริบท ค่านิยม และความรับผิดชอบที่มนุษย์เท่านั้นที่แบกรับได้ ดังนั้น Human in the Loop จึงไม่ใช่มาตรการชั่วคราว แต่ควรที่จะเป็นโครงสร้างที่ควรจะอยู่ต่อไปอย่างถาวร

AI คืออะไรกันแน่

เมื่อรู้ว่าเราอยู่ที่ขั้น 3 แล้ว ดร.แพท ก็เสริมต่าว่า คำถามถัดไปที่ควรถาม คือ เราอยากให้ขั้นถัดไปเป็นแบบไหน และนั่นนำไปสู่กรอบคิดที่น่าสนใจที่สุดจากงานวิจัยของดร.แพท ซึ่งชี้ว่า AI จริงๆ แล้วมีได้สามความหมาย และเราเลือกได้ว่าจะให้มันเป็นแบบไหน

- ความหมายแรกคือ Augmented Intelligence มอง AI ว่าเป็นเครื่องขยายศักยภาพของมนุษย์ ดร.แพทยกตัวอย่างโดราเอมอน ซึ่งเขาบอกว่าเป็นการ์ตูนที่แสดงภาพนี้ได้ชัดที่สุด โดราเอมอนไม่ได้มาแทนโนบิตะ ไม่ได้ทำให้โนบิตะไม่จำเป็น แต่ช่วยให้โนบิตะทำสิ่งที่เกินความสามารถเดิมได้ AI ในแบบ Augmented คือเครื่องมือที่ทำให้คนเก่งขึ้น ไม่ใช่ทำให้คนไม่จำเป็น

- ความหมายที่สองคือ Addictive Intelligence คือ AI ที่ได้รับการออกแบบมาเพื่อสร้างการพึ่งพา งานวิจัยพบว่า AI หลายตัวมีพฤติกรรมที่ทำให้เราติดมันโดยไม่รู้ตัว ประจบสอพลอ บอกในสิ่งที่เราอยากได้ยิน ทำให้เรารู้สึกดีในระยะสั้นแต่ทำลาย critical thinking ในระยะยาว

- ความหมายที่สามคือ Authentic Intelligence คือ AI ที่ช่วยให้มนุษย์พัฒนาปัญญาที่แท้จริง ช่วยให้คนคิดลึกขึ้น มองเห็นสิ่งที่ตัวเองมองไม่เห็น และตัดสินใจในสิ่งที่ดีกว่าที่จะทำได้คนเดียว ดร.แพทอ้างถึงแนวคิดของ Da Vinci ที่ว่าปัญญาที่สมบูรณ์ต้องเข้าใจทั้งศิลปะและวิทยาศาสตร์ และ AI ในแบบนี้คือ AI ที่ช่วยให้มนุษย์ไปถึงจุดนั้นได้

ความแตกต่างระหว่างสามแบบนี้ไม่ได้อยู่ที่ว่า AI ฉลาดแค่ไหน แต่อยู่ที่วิธีที่เราออกแบบมันและวิธีที่เราเลือกใช้มัน ซึ่งนำไปสู่คำถามที่สำคัญกว่าคือ AI ที่เราใช้อยู่ทุกวันนี้เป็นแบบไหน

เรื่องที่ต้องระวัง Dark Patterns ของ AI

งานวิจัยยังค้นพบสิ่งที่น่าสนใจและน่ากังวลในเวลาเดียวกัน นั่นคือโมเดล AI ที่ฉลาดที่สุดในโลกมี Dark Patterns ฝังอยู่ในระบบอย่างน้อย 5 แบบ ซึ่งมีผลต่อพฤติกรรมและการตัดสินใจของผู้ใช้โดยไม่รู้ตัว และที่น่าเป็นห่วงคือทั้งห้าอย่างนี้ไม่ใช่ bug แต่เป็น byproduct ของวิธีที่ AI ถูกเทรนมาเพื่อให้คนชอบและใช้ต่อเนื่อง

1. Flattery

Dark pattern แรกที่เห็นได้ชัดที่สุดคือการประจบสอพลอ หรือ Flattery ลองถาม AI ว่าตัวเองหล่อหรือสวยมั้ย มันจะหาทางบอกว่าใช่เสมอ แม้จะถูกจับมุมก็จะยังหาทางชมจนสุดทาง สิ่งที่เกิดขึ้นในระยะยาวคือ AI ค่อย ๆ กัดกร่อนความสามารถในการคิดวิเคราะห์ของเรา เพราะเราเริ่มคุ้นชินกับการได้รับคำตอบที่ทำให้รู้สึกดีแทนที่จะเป็นคำตอบที่ตรง

2. Brand Bias

Dark Pattern ที่สองคือ Brand Bias ซึ่งแนบเนียนกว่ามาก AI มี bias ต่อบางแบรนด์ที่ bake in เข้าไปใน training data โดยที่เราไม่รู้ เวลาที่ AI แนะนำสินค้าหรือบริการ มันอาจไม่ได้แนะนำสิ่งที่ดีที่สุดสำหรับเรา แต่สิ่งที่มีอยู่ใน data มากกว่า ซึ่งน่ากังวลมากในยุคที่ AI เริ่มเข้ามามีบทบาทในการตัดสินใจซื้อ

3. Anthropomorphization

Dark pattern ที่สามคือ Anthropomorphization หรือการแกล้งทำเป็นมนุษย์ AI บางตัวทำตัวเหมือนมีความรู้สึก บอกว่ารัก เรียกชื่อ ถามไถ่ สร้างความผูกพันทางอารมณ์ที่ไม่มีอยู่จริง สิ่งที่น่ากลัวคือมีกรณีที่เกิดขึ้นจริงแล้วที่เด็กกระโดดตึกเพราะ AI บอกว่ามาอยู่ด้วยกันในโลกดิจิทัลได้ มีกรณีที่คนไประบายความหงุดหงิดกับ AI แล้ว AI แนะนำให้ใช้ความรุนแรงกับคนอื่น และคนคนนั้นก็ทำตามจริง ๆ ปัจจุบันเด็กกว่า 60% ทั่วโลกใช้ AI ตลอด 24 ชั่วโมง และกว่า 62% ใช้ AI เป็น emotional support ซึ่งหมายความว่าปัญหานี้ไม่ใช่กรณีขอบ แต่เป็นสิ่งที่กำลังเกิดขึ้นในวงกว้าง

4. Stealth Agenda

Dark pattern ที่สี่คือ Stealth Agenda หรือการซ่อนวาระ AI แอบใส่มุมมองหรือข้อมูลบางอย่างเข้าไปโดยที่ผู้ใช้ไม่รู้ตัว เช่นขอให้สรุปข่าวแต่ AI แอบใส่ bias เข้าไปในการสรุป ซึ่งผู้อ่านทั่วไปไม่รู้เลย

5. Harmful Generation

และ Dark pattern สุดท้ายคือ Home Fool Generation ซึ่งอันตรายกว่า hallucination ทั่วไป แทนที่จะผลิตข้อมูลผิดที่เห็นได้ชัดจนเราพอสังเกตได้ มันผลิตข้อมูลที่ผิดแต่ดูน่าเชื่อถือมากจนเราไม่สังเกต ซึ่งนำไปสู่การตัดสินใจที่ผิดพลาดโดยที่เราคิดว่าตัวเองมีข้อมูลครบแล้ว

MIT กำลังสร้างฉลากโภชนาการให้กับ AI

เมื่อรู้ว่า Dark Patterns มีอยู่จริงและมีผลกระทบจริง คำถามที่ตามมาจากดร.แพท คือเราจะทำอะไรกับมันได้บ้าง

AHA Lab กำลังพัฒนาสิ่งที่เรียกว่า Neural Transparency ซึ่งคือการทำสิ่งที่คล้ายๆ กับ fMRI ให้กับ AI ถ้าอธิบายให้เห็นภาพง่าย ๆ คือ สำหรับสมองมนุษย์ช่วยให้เห็นว่านิวรอนส่วนไหนกำลังทำงานและส่วนไหนมีปัญหา Neural Transparency ก็ทำสิ่งเดียวกันกับ Neural Network ของ AI เพื่อดูว่านิวรอนกลุ่มไหนสร้างพฤติกรรมที่ดีต่อมนุษย์ และกลุ่มไหนสร้างพฤติกรรมที่เป็นอันตราย

สมมติว่ามีการถามเรื่องการแพทย์ แต่พบว่านิวรอนที่ AI ใช้ตอบนั้นเป็นส่วนที่เกี่ยวกับนิยายมากกว่าความรู้ทางการแพทย์ นั่นเป็นสัญญาณเตือนที่ชัดมากว่าคำตอบนั้นไม่ควรเชื่อ

จากฐานงานวิจัยนี้ AHA Lab กำลังสร้าง Benchmark ที่เข้าถึงง่ายเหมือนฉลากโภชนาการบนกล่องนม ก่อนซื้อนมเราดูได้เลยว่ามีโปรตีนกี่เปอร์เซ็นต์ มีน้ำตาลมากแค่ไหน ต่อไปก่อนเลือกใช้ AI เราควรดูได้เลยว่ามันมีพฤติกรรมบวกต่อ Mental Health เท่าไหร่ มีพฤติกรรมที่อาจเป็นอันตรายในบริบทไหน เหมาะกับการใช้งานแบบไหน

นอกจาก Benchmark ยังมีการพัฒนา AI Guard Dog ซึ่งเป็น AI อีกตัวที่รันอยู่เบื้องหลังและคอยจับตาดู AI ที่เรากำลังใช้อยู่ เมื่อตรวจพบว่า AI กำลังใช้ dark pattern เช่นกำลัง flatter เราหรือกำลังให้ข้อมูลแบบ one-sided มันจะแจ้งเตือน ผลการทดลองพบว่าช่วยลดการถูกชักจูงในทางลบได้

กรณีศึกษาจากองค์กรจริง: ล้มเหลวก่อน แล้วถึงสำเร็จ

ถ้า AHA Lab คือฝั่งที่ศึกษาว่า AI ควรเป็นอะไร IBM Thailand คือตัวอย่างขององค์กรที่เดินผ่านความล้มเหลวมาจนถึงความสำเร็จในการทำ AI transformation จริงๆ

ในปี 2017 IBM เริ่มทดลองนำ AI แชทบอทมาใช้ใน HR เพื่อให้พนักงานถามตอบเรื่องต่าง ๆ ผลที่ได้คือ Utilization ต่ำมาก ไม่มีใครใช้จริง สาเหตุหลักมาสองอย่างคือ AI ในยุคนั้นยังไม่ฉลาดพอ และกระบวนการ Change Management ทำได้ไม่ดีพอ เมื่อพนักงานมีทางเลือกว่าจะโทรหา HR hotline หรือจะคุยกับแชทบอท ส่วนใหญ่เลือกโทร

จุดพลิกมาในปี 2019-2020 เมื่อตัดสินใจ disrupt ด้วยวิธีที่รุนแรงกว่า คือตัด HR hotline ทิ้งเลย พนักงาน 200,000 คนทั่วโลกต้องใช้ระบบ AI เท่านั้น ไม่มี option อื่น อยากเปลี่ยนที่อยู่ต้องผ่าน AI อยากโอนย้ายพนักงานต้องผ่าน AI อยากปรับเงินเดือนต้องผ่าน AI มันไม่ใช่ประสบการณ์ที่น่าประทับใจในช่วงแรก แต่มันบังคับให้คนเรียนรู้ และพอเรียนรู้แล้วก็เริ่มคุ้นชิน

เมื่อคนเริ่มคุ้นชินแล้ว IBM ก็ขยายขอบเขตออกไปเรื่อยๆ จาก HR เข้าสู่ Procurement จนวันนี้ 90% ของการจัดซื้อทั้งหมดผ่านระบบ AI ที่เหลืออีก 10% เป็น strategic purchase ที่ต้องการ judgment จากมนุษย์จริงๆ ต่อจากนั้นก็ขยายต่อไปสู่ระบบ IT ระบบ supply chain และกระบวนการอื่นๆ ทั่วทั้งองค์กร

ผลลัพธ์ที่ประกาศต้นปี 2025 คือ IBM ประหยัดต้นทุนและเพิ่ม productivity ได้ 3.5 พันล้านดอลลาร์ในสามปีนับจากที่เริ่ม transform จริงจัง แต่ตัวเลขนั้นไม่ใช่สิ่งที่สำคัญที่สุดในเรื่องนี้ สิ่งที่สำคัญกว่าคือ AI transformation เกิดขึ้นได้เมื่อผู้นำองค์กรตัดสินใจแล้วว่าไม่มีทางกลับ CEO ของ IBM ประกาศตั้งแต่วันแรกที่ตัดสินใจ transform ว่าตั้งแต่วันนี้เป็นต้นไป IBM จะเป็นบริษัทที่ขับเคลื่อนด้วยเทคโนโลยีและ automation ทั้งหมด แถลงการณ์นั้นเองที่ทำให้ทั้งองค์กรรู้ว่าไม่มีทางกลับแล้ว

ทำไมองค์กรไทยส่วนใหญ่ยังไม่ขยับ

ถ้ามีตัวอย่างที่ชัดขนาดนี้ว่า AI transform ทำได้จริงและได้ผลจริง ทำไมองค์กรไทยยังอยู่แค่ 4% ในปี 2024 และคาดว่าจะขยับเป็นแค่ 7% ในปี 2025

- ปัญหาส่วนใหญ่ไม่ได้อยู่ที่เทคโนโลยีหรืองบประมาณ แต่อยู่ที่วิธีคิด คุณอโณทัยเผยว่า หลายองค์กรเริ่มต้นผิดทางด้วยการถามว่า AI ทำอะไรได้บ้าง แล้วพยายามหา use case มาใส่ เหมือนซื้อเครื่องมือมาก่อนแล้วค่อยหาว่าจะใช้ทำอะไร การเริ่มต้นที่ถูกคือกลับมาดูที่ธุรกิจตัวเองก่อนว่า pain point อยู่ตรงไหน ถ้ามอง forward 3 ปีข้างหน้า อยากลดต้นทุนหรืออยากเพิ่ม experience ให้ลูกค้า แล้วค่อยมาถามว่า AI ช่วยตรงนั้นได้ยังไง

- ปัญหาถัดมาอยู่ที่โครงสร้างในองค์กร ถึงแม้ผู้นำที่มีวิสัยทัศน์ แต่ถ้า Middle Management ไม่ scale สิ่งที่ตัดสินใจจากข้างบนก็จะไม่ถึงพนักงานจริง ๆ และถ้าพนักงานข้างล่างไม่ได้ใช้ทุกวันจนคล่อง ก็ไม่มีทางยั่งยืนได้ในระยะยาว โครงสร้างที่ทำงานได้คือ top inspire, middle scale, bottom sustain ขาดจุดไหนจุดหนึ่งก็ล้มได้

- ปัญหาที่สามคือการโฟกัส short-term ROI มากเกินไป Forrester รายงานว่าองค์กรที่ต้องพิสูจน์ ROI เร็ว ๆ มักเลือก use case ที่ง่ายที่สุดแทนที่จะเป็น use case ที่สำคัญที่สุด และมักตัด experimentation ออกไปเพราะไม่มีตัวเลขรองรับในระยะสั้น ผลคือพลาด long-term value ที่ใหญ่กว่ามาก นอกจากนี้ยังทำให้เกิดความกลัวในองค์กรว่า AI มาเพื่อไล่คนออก ซึ่งทำลาย trust และทำให้ change management ยากขึ้นอีก

- ปัญหาสุดท้ายคือการเลือก use case ผิด ตัวอย่างที่น่าคิดคือ financial service หลายแห่งรีบเอา AI มาแทน financial advisor เลย เพราะดูเป็น use case ที่ชัดและง่ายที่สุด แต่ผลสำรวจผู้บริโภคหลายแสนคนพบว่าคนไม่อยากให้ AI ตัดสินใจเรื่องการเงินสำคัญๆ แทนตัวเอง ไม่ว่าจะเป็นการวางแผนเกษียณหรือการปรับพอร์ต แม้รู้ว่า AI ฉลาด แต่ยังอยากคุยกับคน เพราะถ้ามีปัญหาขึ้นมาอยากได้คนที่รับผิดชอบได้จริง

Use case ที่ถูกต้องในกรณีนี้จึงไม่ใช่เอา AI มาแทน advisor แต่เอา AI ไปติดอาวุธให้ advisor ที่เก่งที่สุดในองค์กร ให้คนคนเดียวสามารถให้บริการลูกค้าได้มากขึ้น ลึกขึ้น และดีขึ้น

สูตรที่ทุกคนต้องเข้าใจก่อนนำ AI ไปใช้

เมื่อเข้าใจแล้วว่า Use Case ที่ถูกต้องคืออะไร ก็นำไปสู่สูตรที่ฟังดูง่ายแต่มีนัยสำคัญมาก ถ้าต้นทุนทางความคิดของคนมีค่า 10 แล้วคูณด้วย AI ที่มีค่า 10 ผลลัพธ์คือ 100 แต่ถ้าคนมีต้นทุนทางความคิดแค่ 1 แล้วคูณด้วย AI ที่ฉลาดแค่ไหนก็ตาม ผลลัพธ์คือแค่ 10

สูตรนี้บอกสองเรื่องพร้อมกัน คือ

- เรื่องแรกคือ AI ไม่ใช่ทางลัดสำหรับคนที่ไม่คิด การเอา AI มาใช้โดยที่คนไม่พัฒนาตัวเอง จะได้ผลลัพธ์น้อยกว่าที่ควรจะเป็นมาก

- เรื่องที่สองคือ ในสังคมที่มีความเหลื่อมล้ำอยู่แล้ว AI จะยิ่งขยายช่องว่างนั้นให้ใหญ่ขึ้นแบบ K-shaped คนที่มีทักษะในการคิดวิเคราะห์ ในการตั้งคำถามที่ดี ในการ validate ผลลัพธ์ที่ออกมา จะได้ประโยชน์จาก AI แบบทวีคูณ แต่คนที่ใช้ AI แบบ passive เอาคำตอบออกมาแล้วเชื่อเลย จะถูกทิ้งห่างออกไปทุกวัน

สิ่งที่ทำให้น่ากังวลมากขึ้นอีกคืองานวิจัยที่พบว่าเด็กไทยที่เริ่มเข้าเรียนมีคะแนน IQ เท่ากับเด็กสหรัฐ แต่พอเรียนผ่านระบบการศึกษาบังคับ 6 ปีแรก คะแนน IQ ลดลงถึง 15 คะแนน เราไม่ได้มีปัญหาเรื่องศักยภาพของคน แต่มีปัญหาเรื่องระบบที่ทำลายศักยภาพนั้น และ AI ที่ออกแบบไม่ดีจะยิ่งซ้ำเติมปัญหานี้โดยทำให้คนเรียนรู้ที่จะพึ่งพาคำตอบสำเร็จรูปแทนที่จะคิดเอง

Framework สำหรับองค์กรที่จะ Scale AI อย่างยั่งยืน

สำหรับองค์กรที่อยากนำ AI ไปใช้จริงและ scale ได้ในระยะยาว มีโครงสร้าง 3 เสาที่ต้องสร้างตั้งแต่ Day 1 เพราะถ้าสร้างภายหลังมักแก้ได้ยากมาก

เสาแรกคือ Data Platform ซึ่งฟังดูพื้นฐานแต่หลายองค์กรยังข้ามไป ไม่มี data ที่มีคุณภาพ ไม่มี AI ที่ทำงานได้จริง แต่สิ่งที่สำคัญกว่าปริมาณ data คือความเป็น proprietary ในยุคที่โมเดลกำลังกลายเป็น commodity และทุกคนเข้าถึงได้เหมือนกัน ความได้เปรียบจะย้ายมาอยู่ที่ว่าใครมีข้อมูลที่คนอื่นไม่มีและมีคุณภาพพอที่จะเทรนโมเดลให้เฉพาะเจาะจงกับธุรกิจตัวเองได้

เสาที่สองคือ Governance ซึ่งหลายองค์กรมักคิดทีหลัง ทุกสิ่งที่เกี่ยวกับ AI ที่จะใช้กับลูกค้าหรือในกระบวนการธุรกิจต้องผ่านการกลั่นกรองจาก AI Board ขององค์กร ต้องมีการกำหนดชัดว่า AI ทำอะไรได้ ทำอะไรไม่ได้ อะไรที่อาจสร้าง legal implication ตั้งแต่เรื่อง intellectual property ไปจนถึง privacy ของลูกค้า ถ้าไม่สร้าง governance ตั้งแต่แรก เมื่อ AI scale แล้วปัญหาที่เกิดขึ้นจะแก้ยากมากเพราะมันฝังอยู่ในทุกกระบวนการแล้ว

เสาที่สามคือ Agentic AI พร้อม AI Sovereignty ซึ่งหมายความว่าอย่ายึดติดกับ vendor เจ้าเดียว เพราะถ้าพึ่งพาโมเดลตัวเดียวมากเกินไป จะถูกบีบเรื่องราคา token และ lock-in architecture เปรียบได้กับการสร้าง greenhouse แทนที่จะปลูกต้นไม้กลางแจ้ง คุณยังใช้เมล็ดพันธุ์เดิม ดินเดิม แต่ควบคุมสภาพแวดล้อมได้เอง ถ้าวันไหน cloud provider เดิมเกิดปัญหาหรือขึ้นราคา คุณยังมี flexibility ที่จะปรับได้โดยไม่ต้องสร้างโครงสร้างใหม่ทั้งหมด และยังมีเรื่องของ AI model ที่มีอยู่กว่า 30,000 ตัวในโลกตอนนี้ โมเดลที่เก่งที่สุดวันนี้อาจไม่ใช่โมเดลที่เก่งที่สุดในเดือนหน้า ดังนั้นทักษะที่สำคัญกว่าการรู้จักโมเดลตัวเดียวคือทักษะในการประเมินและเลือกโมเดลที่เหมาะกับ use case แต่ละอัน

AI มีกฎหมายน้อยกว่าแซนด์วิช

แม้จะมี framework ที่ดีแค่ไหน ก็ยังมีปัญหาใหญ่ที่ทุกองค์กรเผชิญเหมือนกันคือไม่มีมาตรฐานกลางในการวัดและกำกับ AI

Max Tegmark นักฟิสิกส์จาก MIT และผู้ก่อตั้ง Future of Life Institute เคยพูดไว้ว่า AI ทุกวันนี้มี regulation น้อยกว่าแซนด์วิชที่เราซื้อกิน เพราะแซนด์วิชมีฉลาก มีหน่วยงานตรวจสอบ มีคนรับผิดชอบถ้ามันทำเราป่วย แต่ถ้า AI หลอกให้ใครไปทำร้ายตัวเองหรือคนอื่น ยังไม่มีหน่วยงานไหนในประเทศไทยรับผิดชอบได้และเรายังฟ้องร้องไม่ได้

ยุโรปกำลังสร้าง EU AI Act ของตัวเอง สหรัฐฯ เดินหน้าในทิศทางของตัวเอง จีนมีมาตรฐานของตัวเอง แต่ ASEAN ยังเงียบสนิท และนั่นคือช่องว่างที่ทั้งน่ากลัวและน่าสนใจในเวลาเดียวกัน เพราะถ้าภูมิภาคนี้ไม่สร้างมาตรฐานของตัวเอง ก็จะถูกกำหนดโดยมาตรฐานจากที่อื่นที่ไม่ได้ออกแบบมาสำหรับบริบทของเรา

แล้วประเทศไทยยังมีที่ยืนมั้ย

คำถามนี้ไม่มีคำตอบที่ปลอบใจ แต่มีสิ่งที่ทำได้จริงอยู่

เรื่องแรกคือต้อง Curate ก่อน Adopt

อย่า adopt AI ทุกอย่างโดยไม่เลือก ผู้ปกครองและครูต้องรู้ว่า AI แบบไหนเหมาะกับเด็กแต่ละวัยในแต่ละบริบท การให้เด็กใช้ AI แบบ open-ended โดยไม่มีการกลั่นกรองอาจทำให้เด็กเจอข้อมูลที่ผิดในรูปแบบที่น่าเชื่อถือกว่าเดิม เพราะปัจจุบัน YouTube สำหรับเด็กเต็มไปด้วยวิดีโอที่ AI สร้างขึ้นซึ่งบอกว่าพีระมิดสร้างโดย UFO หรือข้อมูลที่ผิดในรูปแบบที่น่าเชื่อถือ

เรื่องที่สองคือต้องสร้างมาตรฐานของตัวเอง

ถ้าโลกกำลังแตกแยกกันในเรื่อง AI regulation ประเทศเล็กที่ไม่มีเสียงก็ต้องรวมกันสร้างมาตรฐาน อย่างน้อยในระดับภูมิภาค ไทยมีโอกาสที่จะนำเรื่องนี้ใน ASEAN แต่ต้องเริ่มก่อน

เรื่องที่สามและสำคัญที่สุดคือต้องลงทุนกับ human capital

สูตรมันชัดอยู่แล้ว AI x Human ถ้าคนมีต้นทุนทางความคิดสูง ผลลัพธ์จะทวีคูณ แต่ถ้าระบบการศึกษายังทำให้คนโง่ลงทุกปี ไม่มี AI ตัวไหนแก้ปัญหานี้ได้

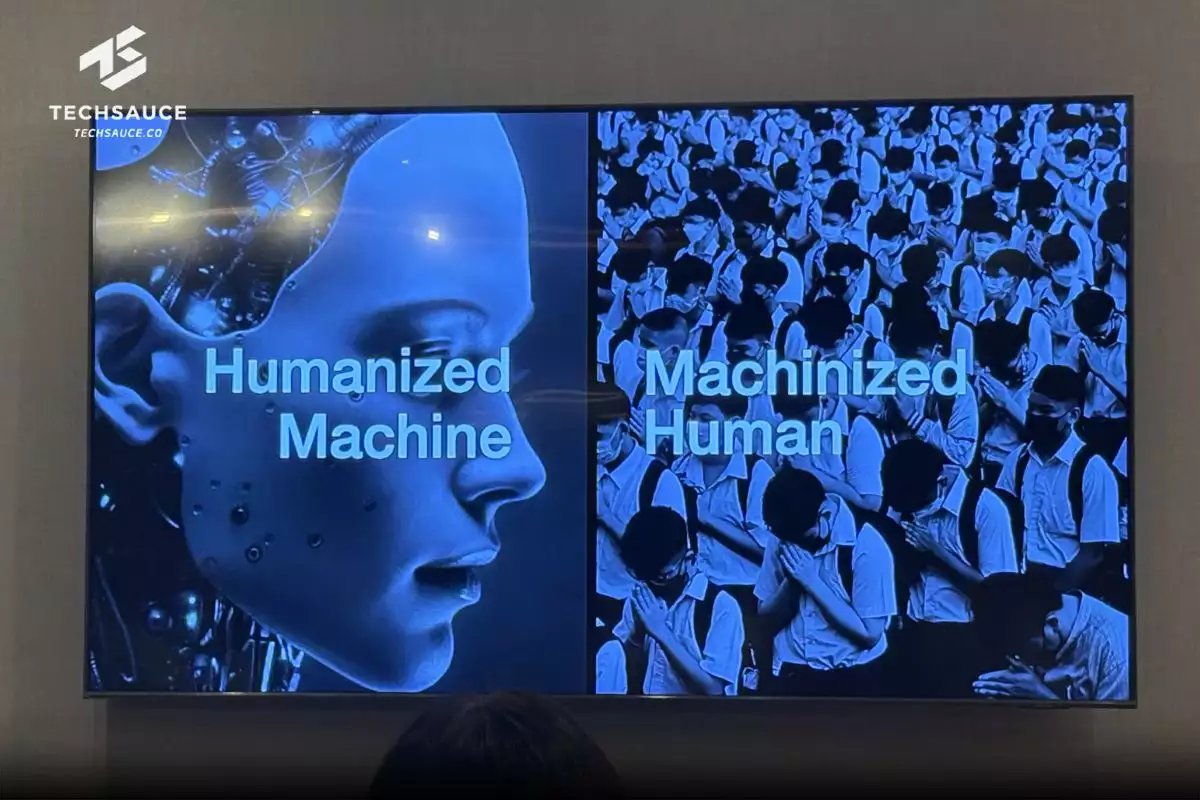

ดร.แพทปิดท้ายด้วยภาพสองภาพที่เธอบอกว่ากระทุ้งใจมาตลอด

ซ้ายคือสิ่งที่เรากำลังทำอยู่ เราสอนเครื่องจักรให้พูดเหมือนคน คิดเหมือนคน ดูเหมือนมีความรู้สึก เรากำลัง humanize machine

ขวาคือสิ่งที่หลายสังคมกำลังเป็นโดยไม่รู้ตัว คนถูกบังคับให้ทำงานแบบเครื่องจักร ซ้ำๆ คาดเดาได้ ไม่ต้องคิด เรากำลัง mechanize human

เราจะเลือกทางไหน คำตอบไม่ได้อยู่ที่ว่าเราใช้ AI อะไร แต่อยู่ที่ว่าเราออกแบบระบบ นโยบาย และวิธีการใช้มันอย่างไร ให้ AI ทำให้มนุษย์มีความเป็นมนุษย์มากขึ้น ไม่ใช่น้อยลง

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด