OpenAI เปิดตัว 3 โมเดลเสียง ‘Realtime API’ ยกระดับ Voice AI ให้ใช้เหตุผล แปลภาษา และถอดเสียงสดได้ในตัวเดียว

OpenAI ประกาศเพิ่มโมเดลเสียงใหม่ 3 ตัวเข้าสู่ Realtime API พร้อมกัน เปิดทางให้นักพัฒนาสร้างแอปเสียงรุ่นใหม่ที่ฟังเข้าใจ คิดต่อเป็น แปลภาษาได้สด และถอดเสียงแบบเรียลไทม์ในระดับที่ใกล้เคียงการสนทนาของมนุษย์มากขึ้น โดยมีบริษัทอย่าง Zillow, Deutsche Telekom, Priceline, Vimeo และ BolnaAI ร่วมทดสอบใช้งานในระบบจริงตั้งแต่ช่วงก่อนเปิดตัว

โมเดลทั้งสามตัวที่เปิดให้นักพัฒนาเรียกใช้แล้วประกอบด้วย GPT-Realtime-2 ซึ่งเป็นโมเดลเสียงตัวแรกของ OpenAI ที่ใช้ความสามารถด้านการให้เหตุผลระดับเดียวกับ GPT-5, GPT-Realtime-Translate โมเดลแปลภาษาแบบสดที่รองรับภาษาต้นทางกว่า 70 ภาษา และ GPT-Realtime-Whisper โมเดลถอดเสียงเป็นข้อความ (Speech-to-Text) แบบสตรีมมิ่งที่ทำงานทันทีขณะผู้พูดยังพูดอยู่

เสียงกำลังกลายเป็นอินเทอร์เฟซหลักระหว่างคนกับซอฟต์แวร์

OpenAI ระบุว่าเสียงกำลังกลายเป็นวิธีที่เป็นธรรมชาติที่สุดในการสั่งงานซอฟต์แวร์ ไม่ว่าจะเป็นการขอความช่วยเหลือระหว่างขับรถ การปรับแผนเดินทางขณะเดินอยู่ในสนามบิน หรือการรับบริการในภาษาที่ตัวเองถนัด แต่การสร้างผลิตภัณฑ์เสียงที่ใช้งานได้จริงนั้นต้องอาศัยมากกว่าการตอบโต้ที่รวดเร็วหรือเสียงพูดที่เป็นธรรมชาติ Voice Agent ต้องเข้าใจความหมายของสิ่งที่ผู้ใช้ต้องการ จดจำบริบทได้ ปรับตัวเมื่อคำขอเปลี่ยนกลางทาง ใช้เครื่องมือ (Tool Use) ระหว่างที่บทสนทนายังดำเนินอยู่ และตอบให้เข้ากับสถานการณ์ในขณะนั้น

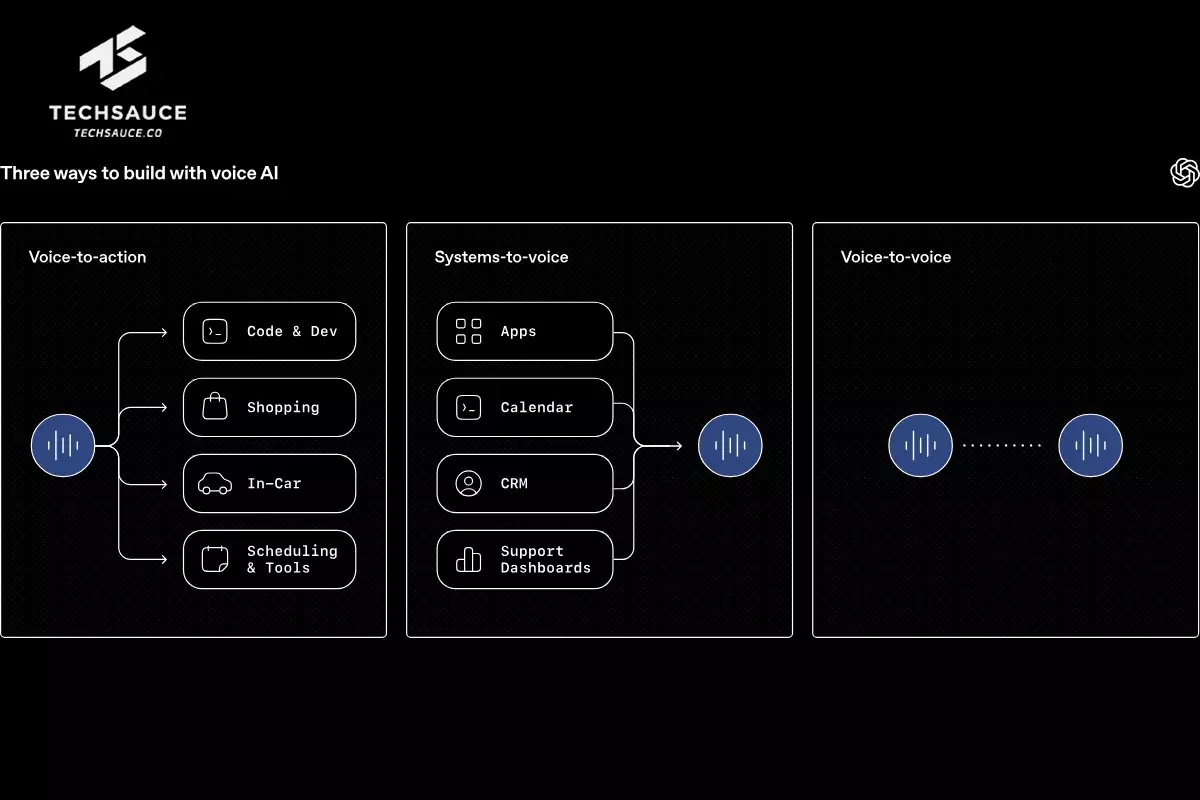

OpenAI ชี้ว่านักพัฒนากำลังสร้างผลิตภัณฑ์เสียงรอบรูปแบบที่กำลังเกิดขึ้น 3 แบบ ได้แก่ Voice-to-Action ที่ผู้ใช้พูดบอกความต้องการแล้วระบบใช้เหตุผลและเครื่องมือทำงานให้เสร็จ Systems-to-Voice ที่ซอฟต์แวร์เปลี่ยนข้อมูลในระบบเป็นคำพูดเชิงคำแนะนำ และ Voice-to-Voice ที่ AI ช่วยให้บทสนทนาสดดำเนินต่อได้ข้ามภาษาและบริบท ตัวอย่างที่ Zillow กำลังพัฒนาเป็น Voice-to-Action ที่ผู้ซื้อบ้านสามารถสั่งว่า "หาบ้านที่อยู่ในงบ BuyAbility ของฉัน เลี่ยงถนนที่รถพลุกพล่าน และนัดดูบ้านวันเสาร์" ส่วน Deutsche Telekom กำลังทดสอบ Voice-to-Voice ในงานบริการลูกค้าที่ลูกค้าพูดภาษาที่ตัวเองถนัดได้โดยให้โมเดลแปลให้เรียลไทม์ ขณะที่ Priceline กำลังเดินไปสู่ภาพที่นักท่องเที่ยวจัดการทริปทั้งหมดด้วยเสียง ตั้งแต่ค้นหาเที่ยวบินและโรงแรมไปจนถึงปรับการจองเมื่อเที่ยวบินดีเลย์

GPT-Realtime-2: โมเดลเสียงที่ใช้เหตุผลและทำงานต่อได้

GPT-Realtime-2 เป็นไฮไลต์หลักของการเปิดตัวครั้งนี้ ออกแบบมาให้บทสนทนาเดินหน้าต่อไปได้ระหว่างที่โมเดลกำลังคิด เรียกเครื่องมือ รับมือกับการแก้คำพูดหรือการถูกขัด และตอบในโทนที่เหมาะกับช่วงเวลานั้น ฟีเจอร์เด่นคือ Preambles ที่ให้นักพัฒนาเปิดให้โมเดลพูดวลีสั้นก่อนตอบหลักได้ เช่น "เดี๋ยวเช็คให้ก่อนนะครับ" หรือ "รอแป๊บ กำลังดูข้อมูลให้อยู่" เพื่อให้ผู้ใช้รู้ว่าระบบกำลังทำงานอยู่ ไม่ใช่ค้าง

นอกจากนี้ยังเรียกเครื่องมือพร้อมกันได้หลายตัว (Parallel Tool Calls) และพูดออกมาให้ได้ยินว่ากำลังทำอะไร เช่น "กำลังเปิดปฏิทินให้อยู่" เพื่อให้ Agent ดูตอบสนองตลอดเวลา ส่วน Recovery Behavior ก็แข็งแรงขึ้น โมเดลจะพูดว่า "ตอนนี้มีปัญหาเล็กน้อยในส่วนนี้" แทนการเงียบไปเฉยๆ หรือทำให้บทสนทนาขาดตอน

ในเชิงโครงสร้าง OpenAI ขยายหน้าต่างบริบท (Context Window) จาก 32K เป็น 128K เพื่อรองรับเซสชันยาวและงาน Agentic ที่ซับซ้อนขึ้น โมเดลเข้าใจคำเฉพาะทาง ชื่อเฉพาะ และศัพท์ทางการแพทย์ได้ดีขึ้น ปรับโทนเสียงให้สงบเมื่อช่วยแก้ปัญหา เห็นใจเมื่อผู้ใช้หงุดหงิด หรือสดใสเมื่อยืนยันว่าทำงานสำเร็จ และเปิดให้นักพัฒนาเลือกระดับการใช้เหตุผล (Reasoning Effort) ได้ 5 ระดับตั้งแต่ minimal, low, medium, high จนถึง xhigh โดยตั้ง low เป็นค่าเริ่มต้นเพื่อสมดุลระหว่างความหน่วงต่ำและการคิดที่ลึกขึ้นเมื่อจำเป็น

ตัวเลขผลทดสอบจาก OpenAI ระบุว่า GPT-Realtime-2 ระดับ high ทำคะแนนสูงกว่า GPT-Realtime-1.5 ถึง 15.2% บน Big Bench Audio ซึ่งวัดความสามารถด้านการให้เหตุผลกับอินพุตเสียง และระดับ xhigh ทำคะแนนสูงกว่ารุ่นเดิม 13.8% บน Audio MultiChallenge ซึ่งวัดการทำตามคำสั่งและความฉลาดของบทสนทนาแบบหลายเทิร์น

ในมุมของผู้ใช้งานจริง Josh Weisberg ตำแหน่ง SVP and Head of AI ที่ Zillow บอกว่า GPT-Realtime-2 ให้ความฉลาดและความน่าเชื่อถือในการเรียกใช้เครื่องมือสำหรับบทสนทนาเสียงที่ซับซ้อน และในเบนช์มาร์กทดสอบเชิง Adversarial ที่ยากที่สุดของ Zillow โมเดลใหม่ยกอัตราความสำเร็จของสายขึ้น 26 จุด (95% เทียบกับ 69%) หลังการ Optimize Prompt อีกทั้งยังทนทานในเรื่อง Fair Housing Compliance ซึ่งเป็นเรื่องสำคัญมากสำหรับธุรกิจของ Zillow

GPT-Realtime-Translate: แปลภาษาแบบสด รองรับ 70+ ภาษา

GPT-Realtime-Translate ช่วยนักพัฒนาสร้างประสบการณ์เสียงหลายภาษาแบบสด ที่แต่ละฝ่ายพูดภาษาที่ตัวเองถนัดได้และฟังบทสนทนาในเวอร์ชันที่ถูกแปลเรียลไทม์ พร้อมเห็นข้อความถอดเสียงสดไปด้วย โมเดลรองรับภาษาต้นทางมากกว่า 70 ภาษาและภาษาปลายทาง 13 ภาษา จึงเหมาะกับงานบริการลูกค้า การขายข้ามประเทศ การศึกษา อีเวนต์ สื่อ และแพลตฟอร์มครีเอเตอร์ที่มีผู้ชมทั่วโลก

OpenAI อธิบายว่าการแปลแบบสดต้องรักษาความหมายให้ครบและตามจังหวะของผู้พูดให้ทัน แม้คนจะพูดเป็นธรรมชาติ สลับบริบท หรือใช้สำเนียงท้องถิ่นและศัพท์เฉพาะวงการ Vimeo สาธิตการนำโมเดลไปใช้แปลวิดีโออธิบายผลิตภัณฑ์ขณะเล่น เพื่อให้ลูกค้าทั่วโลกฟังอัปเดตในภาษาของตัวเองได้ทันทีโดยไม่ต้องรอเวอร์ชันแปลแยก ส่วน Deutsche Telekom กำลังทดสอบสำหรับงานสนทนาเสียงข้ามภาษา

ฝั่ง BolnaAI ที่สร้าง Voice AI สำหรับตลาดอินเดีย Prateek Sachan ตำแหน่ง Co-founder & CTO ระบุว่าการรับมือกับเสียงพูดของแต่ละภูมิภาคในอินเดียคือโจทย์ใหญ่ และในการทดสอบกับภาษาฮินดี ทมิฬ และเตลูกู GPT-Realtime-Translate ทำ Word Error Rate ต่ำกว่าโมเดลอื่นที่ทดสอบถึง 12.5% พร้อมอัตรา Fallback ที่ต่ำกว่า อัตราทำงานสำเร็จที่สูงกว่า และความหน่วงที่ยังทำให้สนทนาได้เป็นธรรมชาติ

GPT-Realtime-Whisper: ถอดเสียงสดที่ทันทุกคำพูด

GPT-Realtime-Whisper เป็นโมเดล Speech-to-Text แบบสตรีมมิ่งที่เน้นความหน่วงต่ำเป็นพิเศษ โมเดลถอดเสียงเป็นข้อความขณะที่คนยังพูด ทำให้ผลิตภัณฑ์ที่ต้องทำงานสดรู้สึกเร็วขึ้น ตอบสนองมากขึ้น และเป็นธรรมชาติขึ้น ตั้งแต่คำบรรยาย (Captions) ที่ขึ้นทันที ไปจนถึงบันทึกการประชุมที่ตามจังหวะการพูดได้ทัน

OpenAI วางตำแหน่งโมเดลนี้สำหรับงานในที่ทำงานที่ต้องใช้คำพูดสด ทั้งคำบรรยายในการประชุม ห้องเรียน รายการถ่ายทอดสด และอีเวนต์ การสรุปบทสนทนาขณะการประชุมยังดำเนินอยู่ Voice Agent ที่ต้องเข้าใจผู้ใช้แบบต่อเนื่อง รวมถึง Workflow การติดตามผลที่เร็วขึ้นในงานบริการลูกค้า สาธารณสุข งานขาย และการสรรหาบุคลากร

ความปลอดภัยและการนำไปใช้

Realtime API ใส่หลายชั้นของกลไกป้องกันการนำไปใช้ในทางผิด โดย OpenAI ใช้ Active Classifier บนเซสชันของ Realtime API เพื่อหยุดบทสนทนาที่ตรวจพบว่าฝ่าฝืนนโยบายเนื้อหาที่เป็นอันตราย และนักพัฒนายังเพิ่ม Safety Guardrail ของตัวเองได้ผ่าน Agents SDK นโยบายการใช้งานของ OpenAI ห้ามนำผลลัพธ์ไปใช้เพื่อสแปม การหลอกลวง หรือจุดประสงค์ที่เป็นอันตราย และนักพัฒนาต้องแจ้งให้ผู้ใช้ปลายทางทราบว่ากำลังคุยกับ AI หากบริบทไม่ชัดเจนพออยู่แล้ว

ราคาและช่องทางใช้งาน

ทั้ง GPT-Realtime-2, GPT-Realtime-Translate และ GPT-Realtime-Whisper เปิดให้ใช้แล้วผ่าน Realtime API โดย GPT-Realtime-2 คิดราคาที่ 32 ดอลลาร์ต่อ 1 ล้าน Audio Input Token (0.40 ดอลลาร์สำหรับ Cached Input Token) และ 64 ดอลลาร์ต่อ 1 ล้าน Audio Output Token ส่วน GPT-Realtime-Translate คิดที่ 0.034 ดอลลาร์ต่อนาที และ GPT-Realtime-Whisper อยู่ที่ 0.017 ดอลลาร์ต่อนาที นักพัฒนาเริ่มต้นได้โดยเปิด Prompt ใน Codex เพื่อเพิ่ม GPT-Realtime-2 เข้าแอปที่มีอยู่หรือสร้างแอปใหม่

ที่มา: OpenAI

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด