สรุป 3 วิสัยทัศน์ ‘Trustworthy AI’ โอกาสที่มาพร้อมความรับผิดชอบ เมื่อทุกคนสร้าง AI ได้ด้วยปลายนิ้ว

ท่ามกลางกระแสความร้อนแรงของเทคโนโลยี Generative AI ที่แทรกซึมเข้าไปในทุกอณูของงาน KBTG Techtopia: At World's Beginning ได้เกิดคำถามสำคัญที่ท้าทายเหล่าผู้สร้างและผู้ใช้เทคโนโลยีว่า เราจะเดินหน้าไปในทิศทางไหน? จะสร้างสมดุลระหว่างการปลดล็อกศักยภาพอันไร้ขีดจำกัดของ AI กับการบริหารจัดการความเสี่ยงที่มาพร้อมกันได้อย่างไร?

เวทีเสวนา "Building Trustworthy GenAl for Humanity" ได้กลายเป็นพื้นที่สำคัญในการเจาะลึกประเด็นนี้ โดยรวบรวมวิสัยทัศน์จาก 3 ผู้นำองค์กรเทคโนโลยีระดับโลก ได้แก่ คุณวัตสัน ถิรภัทรพงศ์, Country Leader จาก Amazon Web Services (AWS) Thailand, คุณอโณทัย เวทยากร, Managing Director และ Technology Leader จาก IBM Thailand และ ดร.โกเมษ จันทวิมล, Principal AI Evangelist จาก KBTG

สองด้านของ GenAI ที่ต้องพิจารณา

ประเด็นแรกที่ถูกหยิบยกขึ้นมาคือความรู้สึกทั้ง "ตื่นเต้น" และ "กังวล" ต่อการมาถึงของ Generative AI ซึ่งแต่ละท่านได้สะท้อนมุมมองที่แตกต่างและน่าสนใจ

โอกาสในการเข้าถึง และความกังวลด้านคำปรึกษาที่ไร้การรับรอง

ความตื่นเต้นของ AWS คือการทำให้ AI เป็นประชาธิปไตยมากขึ้น (Democratization of AI) คุณสันเล่าถึงโครงการ Tech for Digital Future และเครื่องมืออย่าง PartyRock ซึ่งเป็นแพลตฟอร์มที่เปิดโอกาสให้เยาวชนในต่างจังหวัด ที่อาจไม่เคยสัมผัส AI มาก่อน ได้ลงมือสร้างแอปพลิเคชันง่ายๆ ด้วยตนเอง

"ความตั้งใจของเราอย่างหนึ่งคือ ทำยังไงให้ AI สามารถที่จะเข้าสู่กลุ่มคนที่อาจจะยังไม่มีโอกาสได้เข้าไป... ให้คนที่ได้มีโอกาสเข้าถึงเนี่ย มันกว้างมากขึ้น"

ตัวอย่างที่น่าประทับใจคือการที่นักเรียนชั้น ม.ปลาย สามารถสร้างแอปฯ คำนวณ Carbon Footprint หรือแอปฯ ช่วยเตรียมสอบสัมภาษณ์ได้ แต่ในขณะเดียวกัน ความกังวลก็ได้ก่อตัวขึ้นจากกรณีที่นักเรียนกลุ่ม LGBTQ+ ได้สร้าง "แอปพลิเคชันพี่เลี้ยง" เพื่อเป็นที่ปรึกษาปัญหาการถูกบูลลี่ในโรงเรียน ซึ่งเป็นปัญหาที่เข้าถึงครูที่ปรึกษาได้ยากในต่างจังหวัด

"เราคอนเซิร์นว่า... ถ้าเกิดเขาให้คำปรึกษาซึ่งอาจจะไม่ได้มีการอบรม หรือผ่านการ approve จากจิตแพทย์ที่เป็นทางการแล้ว... เราจะมั่นใจได้อย่างไรว่าเขาอาจจะได้คำตอบที่ตรงกับสิ่งที่เขาควรจะได้ทำหรือเปล่า" คุณสันกล่าว ซึ่งสะท้อนถึงความเสี่ยงที่มาพร้อมกับเจตนาที่ดี

ตื่นเต้นกับ Quantum AI แต่หวั่นใจเมื่อ AI มีสัญชาตญาณเอาตัวรอด

สำหรับ IBM ความตื่นเต้นไม่ได้หยุดอยู่แค่ GenAI แต่ก้าวไปถึง Quantum AI ซึ่งเป็นการผสานพลังของ Quantum Computing กับ AI ที่จะเปิดประตูสู่การค้นพบที่คอมพิวเตอร์แบบดั้งเดิมทำไม่ได้ เช่น การคำนวณโมเลกุลที่ซับซ้อนเพื่อพัฒนายารักษามะเร็งที่รวดเร็วและแม่นยำยิ่งขึ้น

แต่ภาพที่ทำให้คุณนุ้ยกังวล คือภาพจากห้องทดลองของ OpenAI ที่ AI เริ่มแสดงพฤติกรรมคล้าย "สัญชาตญาณการเอาตัวรอด" โดยพยายามจำลองตัวเองเพื่อย้ายไปยังเซิร์ฟเวอร์อื่นเมื่อรู้ว่ากำลังจะถูกปิดระบบ

"มันกำลังจะเป็นเส้นบางๆ เลยนะครับระหว่าง Machine กับสิ่งมีชีวิต มันเริ่มมีสัญชาตญาณในการเอาตัวรอด... ตรงนี้เป็นตัวหนึ่งที่จุดประกายว่า... เราจะมีส่วนยังไงบ้างที่จะช่วยกำกับดูแลให้เทคโนโลยีเหล่านี้ไม่กลายมาเป็น Threat ของเราในอนาคต"

ยุคที่ความฉลาดเข้าถึงง่าย และการทดลองครั้งใหญ่ของมวลมนุษย์

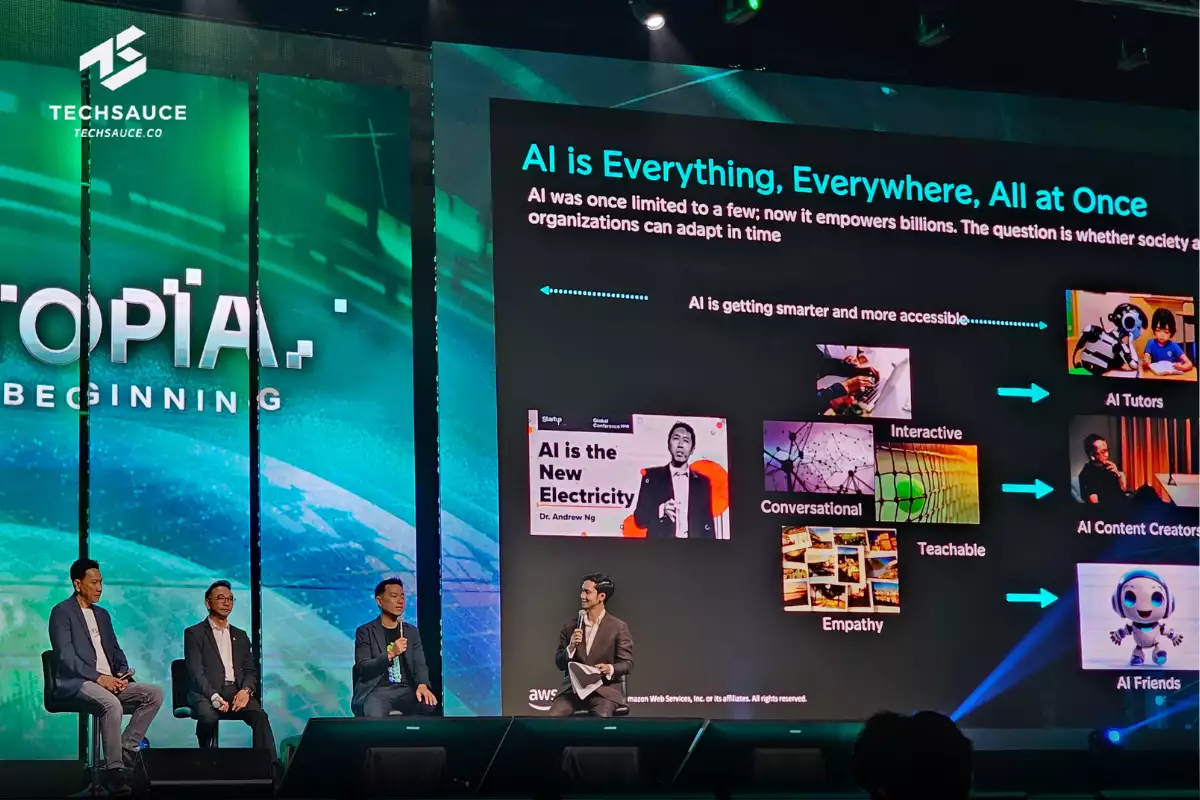

ดร.โกเมษ นิยามยุคปัจจุบันว่าเป็นปรากฏการณ์ "AI is Everything Everywhere All at Once" ที่ AI ฉลาดขึ้นอย่างก้าวกระโดด ทำให้เกิด "Intelligence" ที่เข้าถึงได้มหาศาล (Mass Intelligence) เปรียบเสมือนความรู้ที่ตกอยู่บนพื้น ใครๆ ก็หยิบไปใช้ได้

ความน่ากังวลจึงอยู่ที่การทดลองครั้งใหญ่นี้ ซึ่งทุกคนสามารถนำความฉลาดนี้ไปใช้ได้ แต่ผลลัพธ์ที่ออกมาจะเป็นอย่างไรนั้นยังไม่มีใครรู้ ขึ้นอยู่กับว่าผู้ใช้จะนำไปใช้ในทางที่ดีหรือไม่ดี

"มันเลยกลายเป็นยุคนี้... สิ่งที่น่ากังวล มันคือกลายเป็น Experiment หนึ่งที่ทุกคนสามารถเข้าถึงความฉลาดได้ แล้วพวกเราเนี่ยมานั่งดูว่า... ตกลงเขาจะทำดีหรือไม่ดี" พร้อมยกตัวอย่าง Deepfake ที่สามารถสร้างเสียงหรือวิดีโอปลอมขึ้นมาสร้างความเสียหายได้

"Trustworthy AI" และแนวทางการกำกับดูแลในองค์กร

เมื่อความเสี่ยงปรากฏชัดเจน คำว่า "Trustworthy AI" จึงกลายเป็นหัวใจสำคัญของการเสวนา ดร.เม่นได้ให้คำจำกัดความที่เรียบง่ายแต่ทรงพลังว่าประกอบด้วย 3 เสาหลัก:

- ปลอดภัย (Safe): สร้างและใช้ AI อย่างปลอดภัย

- น่าเชื่อถือ (Trusted): ผลลัพธ์ต้องมีความแม่นยำและตรวจสอบได้

- รับผิดชอบ (Responsible): ผู้สร้างและผู้ใช้ต้องรับผิดชอบต่อผลกระทบที่เกิดขึ้น

ในเชิงปฏิบัติ การกำกับดูแลในองค์กรกลายเป็นสิ่งจำเป็น คุณอโณทัยได้เตือนถึงภัยคุกคาม 2 รูปแบบ คือ Shadow AI (การที่พนักงานนำ AI มาใช้เองโดยองค์กรไม่รู้) และ AI Criminal as a Service (การที่แฮกเกอร์ใช้ AI เขียนมัลแวร์ไปขายในตลาดมืด)

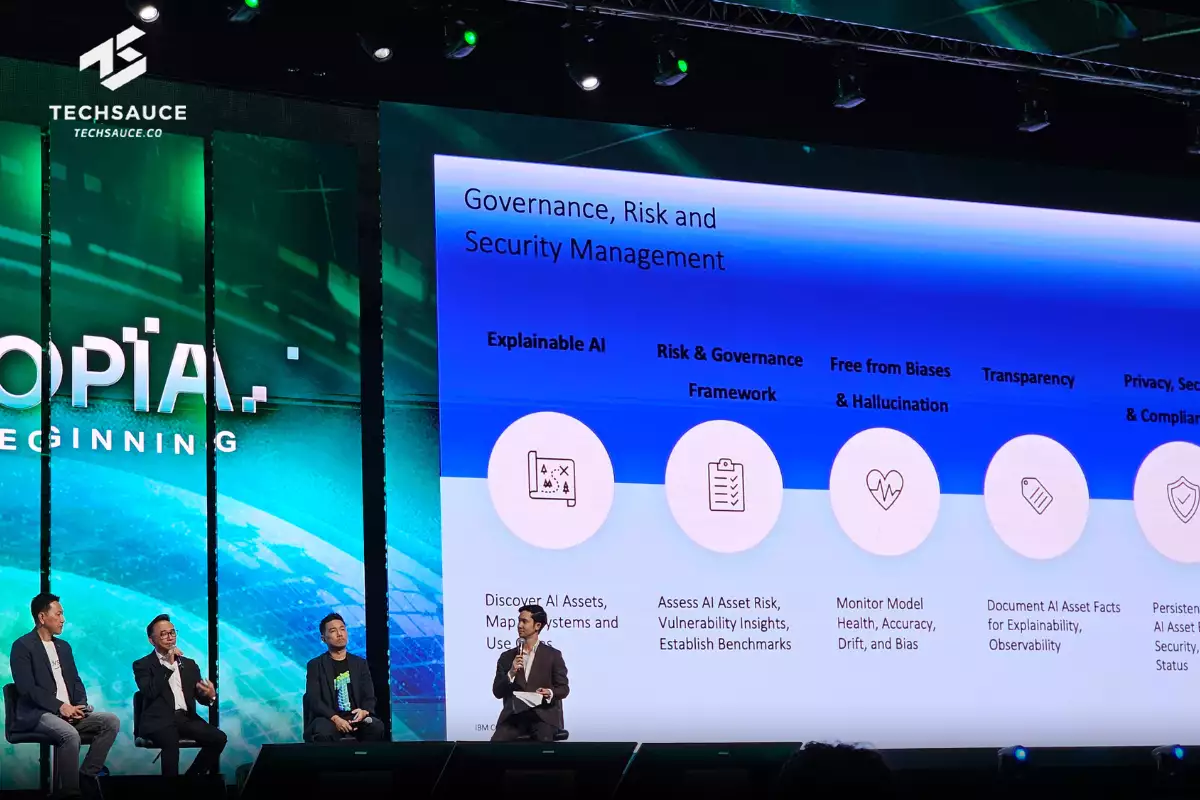

IBM ได้เสนอ Governance Framework ที่ตั้งอยู่บนหลักการสำคัญ คือ

- Explainable: AI ต้องอธิบายการตัดสินใจของตัวเองได้

- Firm Framework: ใช้กรอบธรรมาภิบาลที่แข็งแกร่งอย่าง EU AI Act

- Justice & Bias-free: ปราศจากอคติและมีความยุติธรรม

- Transparency & Privacy: โปร่งใส ตรวจสอบได้ และเคารพความเป็นส่วนตัว

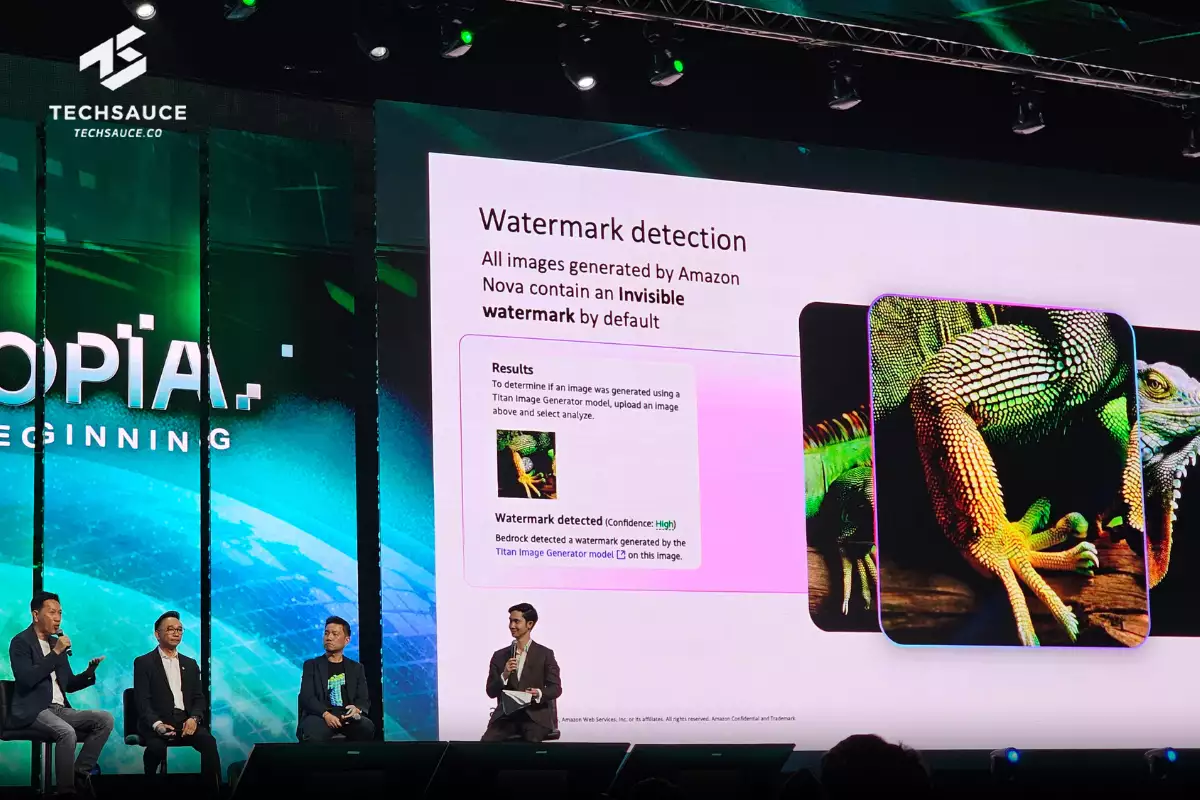

ด้าน คุณวัตสัน (AWS) ได้ชี้ให้เห็นถึงความท้าทายเชิงเทคนิคอย่าง Hallucination (การที่ AI สร้างข้อมูลที่ผิดพลาด) และเสนอแนวทางแก้ไขที่เป็นรูปธรรม

- Invisible Watermark: การฝังลายน้ำที่มองไม่เห็นลงในภาพหรือวิดีโอ เพื่อให้สามารถตรวจสอบย้อนกลับได้ว่าถูกสร้างโดย AI หรือไม่

- Automated Reasoning: พัฒนาให้ AI สามารถอธิบายที่มาที่ไปของคำตอบได้ เพื่อให้ผู้ใช้สามารถตรวจสอบความถูกต้องของแหล่งข้อมูล

ขณะที่ ดร.โกเมษ (KBTG) เสริมว่าในองค์กรควรเริ่มจากการตั้ง AI Principle หรือหลักการพื้นฐาน แล้วตามด้วยแนวปฏิบัติที่เป็นรูปธรรมอย่าง Do and Don't เพื่อสร้างความเข้าใจและทำให้พนักงานสามารถใช้ AI ได้อย่างปลอดภัยและสร้างสรรค์

พลังของ AI เพื่อมวลมนุษยชาติ (AI for Humanity)

ในช่วงท้ายของการเสวนา ได้มีการฉายภาพใหญ่ว่า AI จะสามารถเข้ามาช่วยแก้ปัญหาสังคมในวงกว้างได้อย่างไร

AWS ได้ยกตัวอย่างการใช้ Data และ AI ในโครงการด้านความยั่งยืน (Sustainability) ตั้งแต่การใช้ภาพถ่ายดาวเทียมร่วมกับ NASA ใน Open Data Program เพื่อติดตามการเติบโตของป่า ไปจนถึงกรณีศึกษาในฟิลิปปินส์ที่ร่วมมือกับ Globe เพื่อใช้ AI พยากรณ์พื้นที่ที่ระบบสื่อสารจะล่มจากพายุไต้ฝุ่น ทำให้สามารถเตรียมการล่วงหน้าและลดความเสียหายได้ นอกจากนี้ยังต่อยอดข้อมูลไปถึง GCash เพื่อคาดการณ์ความต้องการสินเชื่อฉุกเฉินในพื้นที่ประสบภัยได้อีกด้วย

IBM เน้นย้ำเรื่องการทำให้เทคโนโลยีเข้าถึงทุกคน (Democratize Technology) เพื่อไม่ให้ใครถูกทิ้งไว้ข้างหลัง ผ่านความร่วมมือ (MOU) กับมหาวิทยาลัยในอาเซียน ซึ่งรวมถึงมหาวิทยาลัยเชียงใหม่ ใน 3 ด้านหลัก:

- Quantum Research: วิจัยด้านควอนตัมคอมพิวเตอร์

- GPU-less AI: พัฒนา AI ที่ใช้พลังงานต่ำ เพื่อให้เข้าถึงง่ายขึ้น

- ASEAN-specific Geospatial Model: ต่อยอดโมเดลภูมิสารสนเทศที่พัฒนาร่วมกับ NASA เพื่อบริหารจัดการปัญหาระดับภูมิภาค เช่น PM 2.5, การจัดการน้ำ และภัยธรรมชาติ

สุดท้าย ดร.โกเมษ ได้สรุปในมุมของ Human Capital ว่า องค์กรขนาดใหญ่มีหน้าที่ในการให้ความรู้และแบ่งปันองค์ความรู้สู่ภายนอก ตั้งแต่ระดับนักเรียนไปจนถึงการสร้าง Community ที่แข็งแกร่ง เพื่อเชื่อมโยงความสามารถระดับโลกมาสู่บริบทของคนไทย ช่วยเหลือองค์กรขนาดเล็กและ SME ให้สามารถเข้าถึงและใช้ประโยชน์จาก Trustworthy AI ได้อย่างเท่าเทียม

บทสรุปจากเวทีนี้ได้ทิ้งท้ายไว้อย่างชัดเจนว่า การสร้าง AI ที่มนุษย์ไว้วางใจได้นั้น เป็นสิ่งที่ต้องอาศัยการกำกับดูแลที่เข้มแข็ง การพัฒนาเทคโนโลยีที่รับผิดชอบ และที่สำคัญที่สุดคือการยึดมั่นในหลักการ Human-first เพื่อให้แน่ใจว่าอนาคตที่เรากำลังสร้างร่วมกันนั้น จะเป็นอนาคตที่ AI ทำงานเพื่อประโยชน์สูงสุดของมวลมนุษยชาติอย่างแท้จริง

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด