NVIDIA GTC 2026 สรุปทุกอย่างที่ Jensen Huang พูด เข้าใจสมการ ชิป-แร็ค-โรงงาน AI เมื่อ NVIDIA จะเข้าไปอยู่ในทุกเลเยอร์ของโลกคอมพิวเตอร์

เหมือนกับที่เราเคยต้องมีกลยุทธ์เรื่อง Linux ในยุคบุกเบิกอินเทอร์เน็ต มาวันนี้ทุกบริษัทในโลกจำเป็นต้องมีกลยุทธ์ในการใช้ OpenClaw

ประโยคทองจาก Jensen Huang ซีอีโอของ NVIDIA ที่เปิดงาน GTC 2026 เมื่อวันที่ 17 มีนาคม 2026 ซึ่งเป็นการส่งสัญญาณเตือนถึงผู้นำธุรกิจทั่วโลกว่าโลกกำลังเปลี่ยนผ่านสู่ยุคใหม่ของการประมวลผล

งานนี้ NVIDIA ไม่ได้เป็นแค่บริษัทชิปอีกต่อไป แต่กำลังก้าวสู่การเป็นผู้สร้าง AI Factory และผู้คุมโครงสร้างพื้นฐาน AI ระดับโลก

Techsauce รวบรวมประเด็นสำคัญจากงาน Keynote เปิดงาน GTC 2026 ของ Jensen Huang ไว้ดังนี้

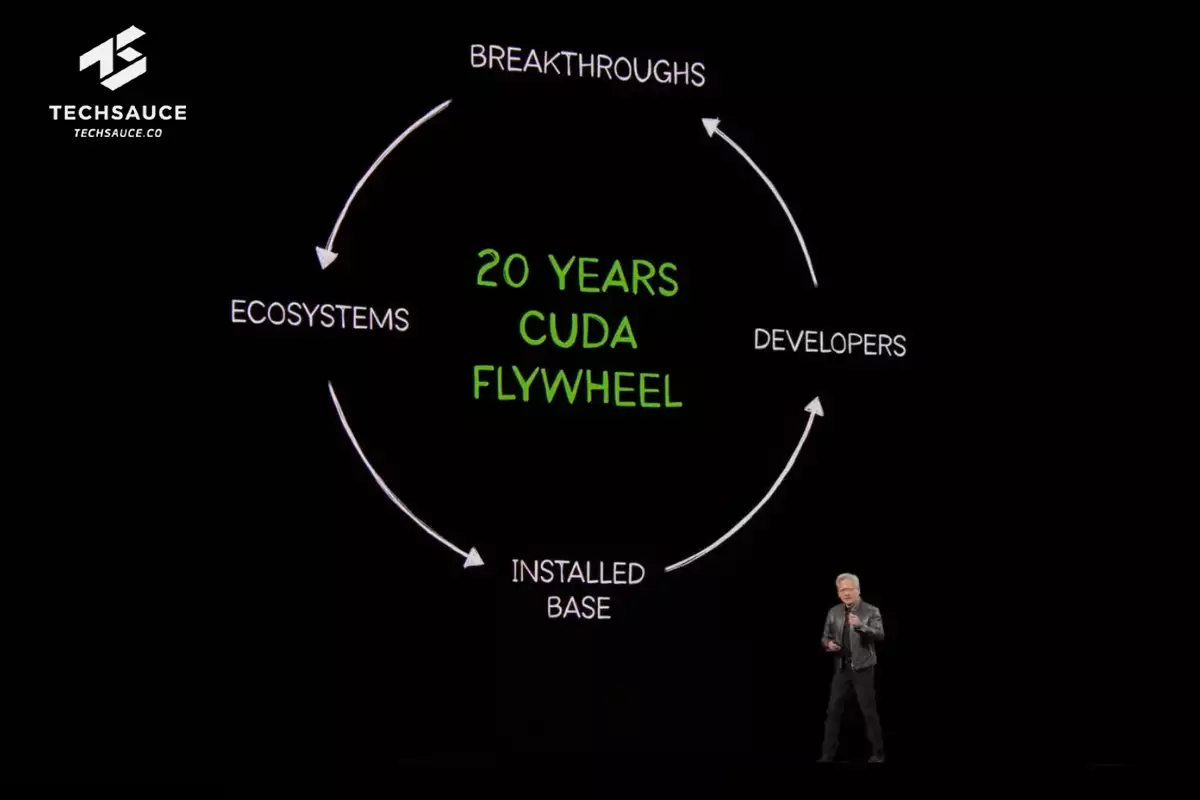

ครบรอบ 20 ปีของ CUDA จุดเริ่มต้นของการเปลี่ยนแปลงแห่งโลก AI

Jensen Huang เริ่มต้นด้วยการฉลอง 20 ปีของ CUDA สถาปัตยกรรมที่ NVIDIA ทุ่มเทพัฒนามาตลอด 2 ทศวรรษ โดยเล่าย้อนไปว่าจุดเริ่มต้นที่แท้จริงมาจากการ์ดจอ GeForce ซึ่งเขาเปรียบว่าเป็น 'แคมเปญการตลาดที่ยิ่งใหญ่ที่สุดของ NVIDIA'

เพราะพ่อแม่เป็นคนจ่ายเงินซื้อการ์ดจอเล่นเกมเหล่านี้ให้กับเด็ก ๆ ตั้งแต่พวกเขายังหาเงินเองไม่ได้ และเด็กเหล่านั้นก็ได้เติบโตขึ้นมาเป็นนักวิทยาศาสตร์คอมพิวเตอร์และนักพัฒนา ที่สุดท้ายก็กลายเป็นเป็นลูกค้าคนสำคัญในเวลาต่อมา

ในยุคแรกเริ่ม NVIDIA ตัดสินใจนำ CUDA ไปติดตั้งไว้ในคอมพิวเตอร์ทุกเครื่องผ่านทาง GeForce ซึ่งถือเป็นการลงทุนที่มหาศาลและยากลำบากมากในตอนนั้น

แต่มันกลับกลายเป็นรากฐานสำคัญที่ทำให้นักวิจัยระดับโลก (เช่น Alex Krizhevsky, Ilya Sutskever และ Jeff Hinton) ค้นพบว่า GPU สามารถนำมาประยุกต์ใช้เพื่อเร่งการประมวลผล Deep Learning ได้ จนเกิดเป็นจุดเริ่มต้นของยุค AI สมัยใหม่

ความทุ่มเทตลอด 20 ปีทำให้ปัจจุบัน CUDA มีฐานระบบที่ติดตั้งอยู่บน GPU และระบบคอมพิวเตอร์หลายร้อยล้านเครื่องทั่วโลก

กลายเป็นว่าตอนนี้เทคโนโลยีของ NVIDIA แทรกซึมอยู่ในทุกระบบคลาวด์ ทุกบริษัทผู้ผลิตคอมพิวเตอร์ และตอบโจทย์เกือบทุกอุตสาหกรรม

ฐานผู้ใช้งานที่มหาศาลนี้ทำให้เกิดสิ่งที่เรียกว่า ‘Flywheel Effect’ หรือการเติบโตแบบกงล้อ กล่าวคือ เมื่อระบบมีฐานผู้ใช้งานกว้างขวาง ก็จะยิ่งดึงดูดนักพัฒนาให้เข้ามาสร้างสรรค์อัลกอริทึมใหม่ ๆ

นำไปสู่การสร้างตลาดใหม่และดึงดูดระบบนิเวศของบริษัทอื่นๆ ให้เข้ามาร่วมด้วย ซึ่งสุดท้ายก็จะวนกลับมาทำให้ฐานผู้ใช้งานของ NVIDIA ขยายตัวใหญ่ขึ้นไปอีก

เปิดกว้าง และทำเองแทบทั้งหมด นี่คือ NVIDIA

และสิ่งที่ทำให้ NVIDIA แตกต่างจากผู้พัฒนาการ์ดจอทั่วไปคือ คือการเป็น Vertically Integrated (บูรณนาการในแนวตั้ง) และ Horizontally Open (เปิดกว้างในแนวนอน) อธิบายให้เห็นภาพคือ

Vertically Integrated

NVIDIA ไม่ได้ทำแค่ชิปฮาร์ดแวร์เพียงอย่างเดียว แต่บริษัทพัฒนาลึกลงไปถึงระบบ ซอฟต์แวร์ อัลกอริทึม และไลบรารีเฉพาะทาง (เช่น CUDA X)

การที่คอมพิวเตอร์จะสามารถเร่งความเร็วในการทำงาน ได้อย่างแท้จริงนั้น NVIDIA จำเป็นต้องเข้าใจและควบคุมการทำงานตั้งแต่ระดับแอปพลิเคชันลงไปจนถึงชิป เพื่อให้เกิดประสิทธิภาพสูงสุดและลดต้นทุนได้อย่างต่อเนื่อง

หรือพูดง่าย ๆ คือ NVIDIA ต้องทำทุกอย่างตั้งแต่ต้นน้ำยันปลายน้ำเพื่อให้ชิปตัวเองมีประสิทธิภาพสูงสุด

Horizontally Open

แม้จะพัฒนาทุกอย่างครบวงจรด้วยตัวเอง แต่ NVIDIA กลับเปิดกว้างให้เทคโนโลยี ซอฟต์แวร์ และไลบรารีของตนสามารถไปเชื่อมต่อและบูรณาการเข้ากับทุกแพลตฟอร์มได้

ไม่ว่าลูกค้าจะต้องการนำไปใช้บนผู้ให้บริการคลาวด์ (เช่น Google Cloud, AWS, Microsoft Azure) นำไปใช้กับผู้ผลิตระบบคอมพิวเตอร์ชั้นนำอย่าง Dell นำไปใช้งานในองค์กร (On-premise) หรือแม้กระทั่งใช้งานในระบบหุ่นยนต์ NVIDIA ก็พร้อมส่งมอบเทคโนโลยีเข้าไปผสานรวมด้วยในทุก ๆ ที่

AI Factory คือโรงงานผลิตความอัจฉริยะของโลก

ปีที่แล้ว Jensen Huang นำเสนอแนวคิด AI Factory โรงงานที่ผลิต Token ซึ่งเป็นหน่วยพื้นฐานของ AI และช่วงที่โลกเราต้องการความฉลาดจาก AI ก็หลีกเลี่ยงไม่ได้ที่เราต้องหาวิธี ‘ผลิต Token เพิ่มให้มากขึ้น'

หน้าที่ของ Token ตามความหมายของ Jensen Huang คือการเปิดพรมแดนใหม่โดยการเปลี่ยนข้อมูลดิบให้กลายเป็นความรู้ โดยดึงเอาสิ่งที่เราได้เรียนรู้ทั้งหมดมาใช้ประโยชน์

นอกจากนี้ โทเค็นยังใช้ประโยชน์จากคลื่นลูกใหม่ของพลังงานสะอาด และเป็นตัวขับเคลื่อนที่ช่วยให้หุ่นยนต์สามารถเรียนรู้ในโลกเสมือน ก่อนที่จะนำไปสร้างเส้นทางใหม่ ๆ และใช้งานจริงในโลกทางกายภาพ

Token และระบบ AI เหล่านี้ถูกออกแบบมาให้ทำงานได้ตลอดเวลาแบบไม่มีหยุดพักในระหว่างทาง พวกมันสามารถเข้าไปทำงานในพื้นที่ที่มือของมนุษย์ไม่สามารถเข้าถึงได้ เพื่อให้พวกเราทุกคนใช้ชีวิต และหายใจได้สะดวกขึ้น

เทคโนโลยีนี้กำลังช่วยทลายขีดจำกัดเดิม ๆ เพื่อช่วยยกระดับโลกใบนี้ให้ก้าวหน้าไปสู่อนาคตที่สดใสสำหรับมวลมนุษยชาติ

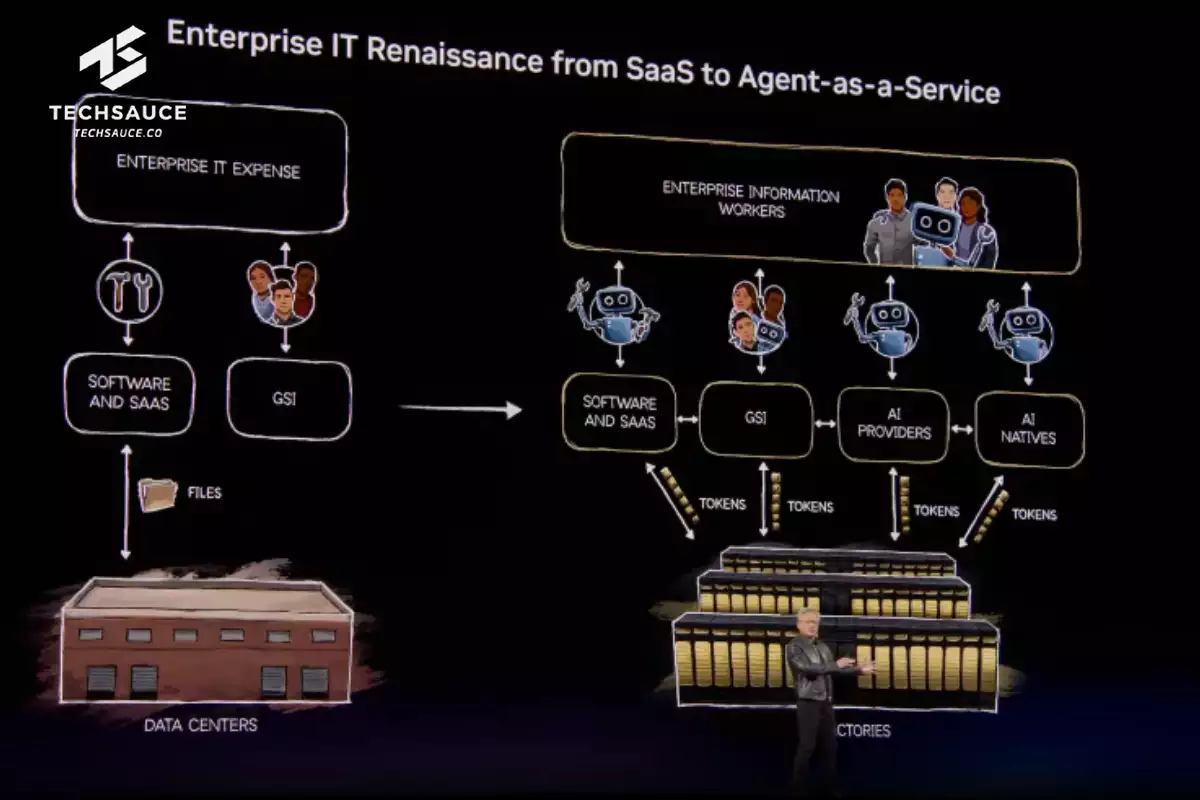

Jensen Huang ได้เปรียบเทียบให้เห็นภาพว่า ระบบ IT หรือ Data Center (ศูนย์ข้อมูล) ในอดีตนั้นถูกเรียกตามฟังก์ชันของมัน นั่นคือเป็นห้องหรืออาคารขนาดใหญ่ที่สร้างขึ้นมาเพื่อจัดเก็บข้อมูลหรือเก็บไฟล์โครงสร้างข้อมูลขององค์กรธุรกิจ แต่สำหรับ AI Factory นั้นถือเป็นแพลตฟอร์มรูปแบบใหม่ของ NVIDIA

แต่ AI Factory ไม่ใช่แค่ Data Center เก่า แต่เป็นโครงสร้างพื้นฐานใหม่ที่ออกแบบมาเพื่อผลิต Intelligence โดยเฉพาะ

ในอนาคต บริษัทซอฟต์แวร์และองค์กรทุกแห่งจะเปลี่ยนผ่านสู่การมีระบบจัดการอัตโนมัติ (Agentic) และกลายสภาพเป็นผู้ผลิต Token

นั่นหมายความว่า AI Factory ไม่ได้มีไว้แค่เก็บข้อมูลอีกต่อไป แต่เป็นโรงงานที่ทำหน้าที่ ผลิตความฉลาด ออกมาในรูปแบบของ Token

โดยผลผลิตและรายได้ของโรงงาน AI เหล่านี้จะถูกประเมินจาก จำนวน Token ที่ผลิตได้ต่อหน่วยพลังงาน เนื่องจากโรงงานทุกแห่งย่อมมีข้อจำกัดด้านพลังงานทางกายภาพ การออกแบบโครงสร้างพื้นฐานให้สามารถผลิต Token ได้มากที่สุด รวดเร็วที่สุด และฉลาดที่สุดภายใต้พลังงานที่มีจำกัด จึงเป็นหัวใจสำคัญของ AI Factory

ด้วยเหตุนี้ NVIDIA จึงได้ก้าวข้ามจากการเป็นเพียงบริษัทผลิตชิป สู่การเป็นผู้สร้าง AI Factory อย่างเต็มตัว โดยมีแพลตฟอร์มอย่าง NVIDIA DSX ที่เป็นระบบ Digital Twin บน Omniverse เข้ามาช่วยออกแบบและบริหารจัดการโรงงาน AI ให้สามารถผลิต Token ได้สูงสุดและใช้พลังงานได้อย่างคุ้มค่าที่สุด

DLSS 5 เข้าสู่โลกการเรนเดอร์ภาพที่เป็นธรรมชาติ

NVIDIA เปิดตัว DLSS 5 เทคโนโลยี Neural Rendering ที่ผสมผสานกราฟิก 3 มิติแบบ Structured data กับ Generative AI

เมื่อนำทั้งสองโลกมารวมกัน DLSS 5 จึงสามารถใช้กราฟิก 3 มิติ (Structured data) เป็นตัวตีกรอบเพื่อควบคุมทิศทางของภาพได้อย่างแม่นยำ

ในขณะเดียวกันก็ให้ Generative AI เป็นตัวสร้างสรรค์รายละเอียดภาพให้สมจริงในเวลาเดียวกัน ผลลัพธ์ที่ได้จึงเป็นเนื้อหาที่สวยงาม น่าทึ่ง และสามารถควบคุมได้อย่างสมบูรณ์แบบ

Jensen เน้นย้ำประโยคสำคัญว่า "ข้อมูลที่มีโครงสร้าง (Structured data) คือรากฐานของ AI ที่น่าเชื่อถือ"

เพราะจุดอ่อนของ Generative AI ทั่วไปคือการคาดเดาผลลัพธ์ได้ยาก (เช่น สร้างภาพมาแล้วผิดสัดส่วน ไม่ตรงกับความเป็นจริงตามธรรมชาติ) แต่เมื่อนำมาผสานกับข้อมูลที่มีโครงสร้างเพื่อควบคุมมัน AI จึงมีความน่าเชื่อถือ และนำไปใช้งานจริงได้อย่างแม่นยำ

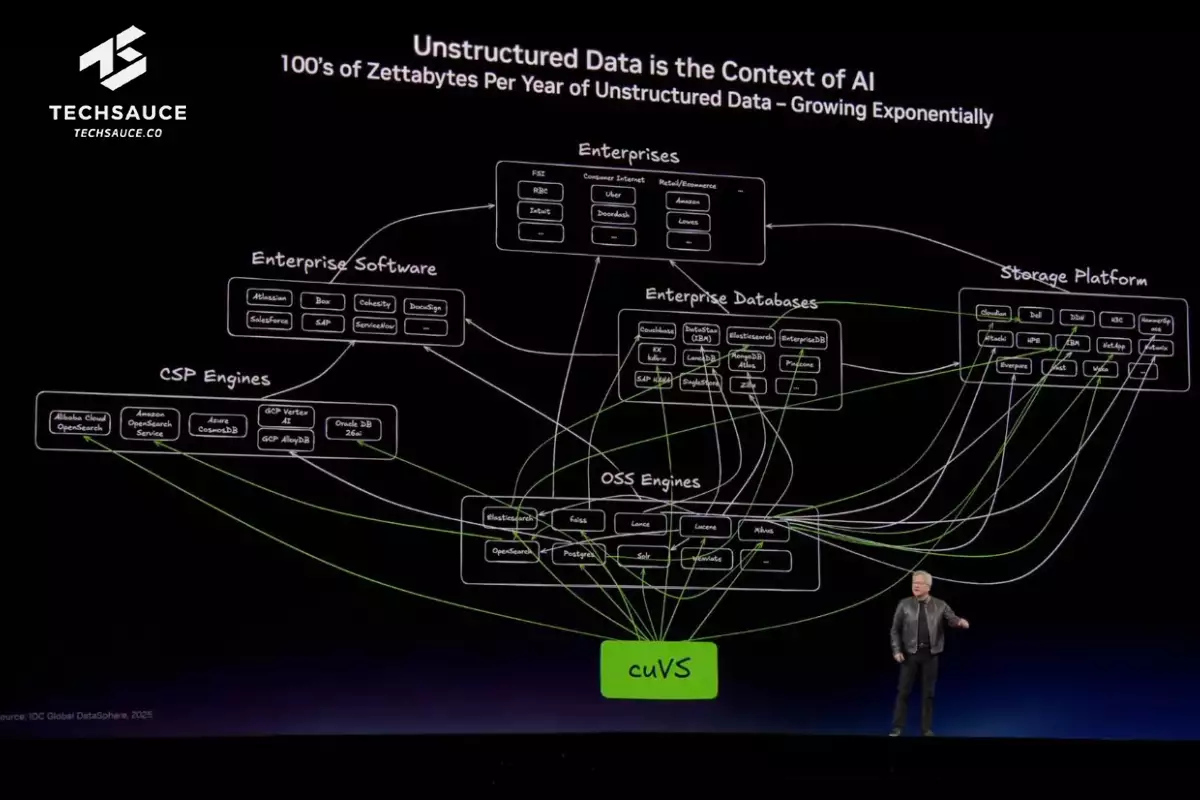

cuDF และ cuVS ทำไม Data Processing ยุค AI ต้องมีสองสิ่งนี้

การปฏิวัติวงการประมวลผลข้อมูล (Data Processing) ในยุค AI ถือเป็นเรื่องสำคัญมาก ซึ่ง NVIDIA ก็ได้ประกาศเปิดตัว 2 ไลบรารีพื้นฐานใหม่ที่เปรียบเสมือนโครงสร้างสำคัญแห่งอนาคต ได้แก่ cuDF และ cuVS

- cuDF - สำหรับ Data Frame หรือ Structured Data เช่น SQL, Spark, Pandas

- cuVS - สำหรับ Vector Store หรือ Unstructured Data เช่น PDF, วิดีโอ, เสียง

แต่ปัจจุบัน AI สามารถรับรู้และเข้าใจข้อมูลได้หลากหลายรูปแบบ (Multi-modality perception) ทำให้มันสามารถอ่านไฟล์ PDF เข้าใจความหมายที่ซ่อนอยู่ และแปลงความหมายนั้นให้อยู่ในรูปแบบโครงสร้างที่สามารถค้นหาและ Query ได้

NVIDIA จึงได้สร้างไลบรารี cuVS ขึ้นมาเพื่อจัดการกับข้อมูลประเภท Vector หรือ Semantic data เหล่านี้โดยเฉพาะ เพื่อเปลี่ยนข้อมูล 90% ที่เคยไร้ค่าให้กลายเป็นขุมทรัพย์แห่งความรู้

การเร่งความเร็วในการประมวลผลข้อมูลไม่เพียงแต่ช่วยเพิ่มความเร็วและขยายขนาดการทำงานได้เท่านั้น แต่ยังช่วยลดต้นทุนได้อย่างมหาศาล ซึ่ง NVIDIA ได้ผนึกกำลังกับบริษัทยักษ์ใหญ่หลายแห่งเพื่อนำไลบรารีเหล่านี้ไปใช้งานจริง ได้แก่

- IBM นำ cuDF ไปช่วยเร่งความเร็วแพลตฟอร์มจัดการข้อมูล WatsonX.data

- Dell นำทั้ง cuDF และ cuVS ไปผสานรวมเข้าด้วยกันเพื่อสร้าง Dell AI Data Platform ซึ่งเป็นแพลตฟอร์มข้อมูลที่ถูกออกแบบมาเพื่อยุค AI โดยเฉพาะ

- Google Cloud นำเทคโนโลยีของ NVIDIA ไปช่วยเร่งความเร็วแพลตฟอร์มคลังข้อมูลระดับโลกอย่าง BigQuery

- Snapchat เป็นตัวอย่างความสำเร็จของการนำระบบมาใช้ โดยสามารถ ลดต้นทุนการประมวลผล ลงได้ถึงเกือบ 80%

ความร่วมมือกับคลาวด์ยักษ์ใหญ่

Google Cloud

- NVIDIA เข้าไปช่วยเร่งการประมวลผลให้กับบริการสำคัญของ Google อย่าง Vertex AI และแพลตฟอร์มจัดการข้อมูลขนาดใหญ่อย่าง BigQuery

- ช่วยลูกค้าอย่าง Baseten, CrowdStrike, Puma และ Salesforce ใช้เทคโนโลยีของ NVIDIA เพื่อโยกไปใช้บริการบน Google Cloud

AWS

- ข่าวใหญ่คือการประกาศนำ OpenAI เข้ามาให้บริการบน AWS ซึ่งจะช่วยเพิ่มขีดความสามารถในการประมวลผลและขยายฐานการใช้งานให้กับ OpenAI ที่กำลังเผชิญปัญหาคอขวดด้านทรัพยากรการประมวลผล

- NVIDIA จะเข้าไปช่วยเร่งการทำงานของแพลตฟอร์มต่าง ๆ เช่น EMR, SageMaker และ Bedrock

Microsoft Azure

- ซูเปอร์คอมพิวเตอร์ A100 เครื่องแรกที่ NVIDIA สร้างขึ้น ถูกนำไปติดตั้งที่ Azure ซึ่งนั่นกลายเป็นจุดเริ่มต้นที่นำไปสู่ความสำเร็จอันยิ่งใหญ่ของ OpenAI

- สร้าง Confidential Computing (การประมวลผลแบบเป็นความลับ) โดยเป็นนวัตกรรมใหม่ที่เกิดขึ้นบน GPU ของ NVIDIA เป็นครั้งแรกในโลก

ระบบนี้ถูกออกแบบมาเพื่อ ปกป้องข้อมูลและโมเดล AI ที่มีมูลค่ามหาศาล (เช่น โมเดลของ OpenAI และ Anthropic) ทำให้มั่นใจได้ว่าแม้แต่ผู้ให้บริการคลาวด์ ก็ไม่สามารถมองเห็นหรือเข้าถึงข้อมูลเหล่านั้นได้

Oracle

- NVIDIA ผันตัวเป็นลูกค้า AI รายแรกของ Oracle จากเดิมที่เป็นคนจัดหาชิปให้ โดยปัจจุบันคลาวด์ของ Oracle เติบโตอย่างมากและเป็นที่ตั้งของพันธมิตรระดับแนวหน้ามากมาย ทั้ง Cohere, Fireworks และ OpenAI

CoreWeave

- สร้าง AI-native cloud แห่งแรกของโลก ซึ่งเป็นคลาวด์ที่ถูกสร้างขึ้นมาโดยมีวัตถุประสงค์เพียงประการเดียว คือการโฮสต์ GPU เพื่อรองรับยุคของการประมวลผลแบบเร่งความเร็วและ AI โดยเฉพาะ

Palantir และ Dell

- สร้าง AI Platform ที่สามารถตั้งได้ทุกที่ แม้แต่พื้นที่ปิดที่ไม่มีการเชื่อมต่ออินเทอร์เน็ตภายนอก (Air-gapped region) โดยใช้เทคโนโลยี Confidential Computing ของ NVIDIA

Openclaw เรื่องที่ Jensen Huang มองว่าทั้งสำคัญและน่ากังวล

Jensen Huang บอกว่าเทคโนโลยี OpenClaw ถือเป็นหนึ่งในไฮไลต์สำคัญที่สุดที่เข้ามาพลิกโฉมวงการ AI และไอทีระดับองค์กรอย่างสิ้นเชิง

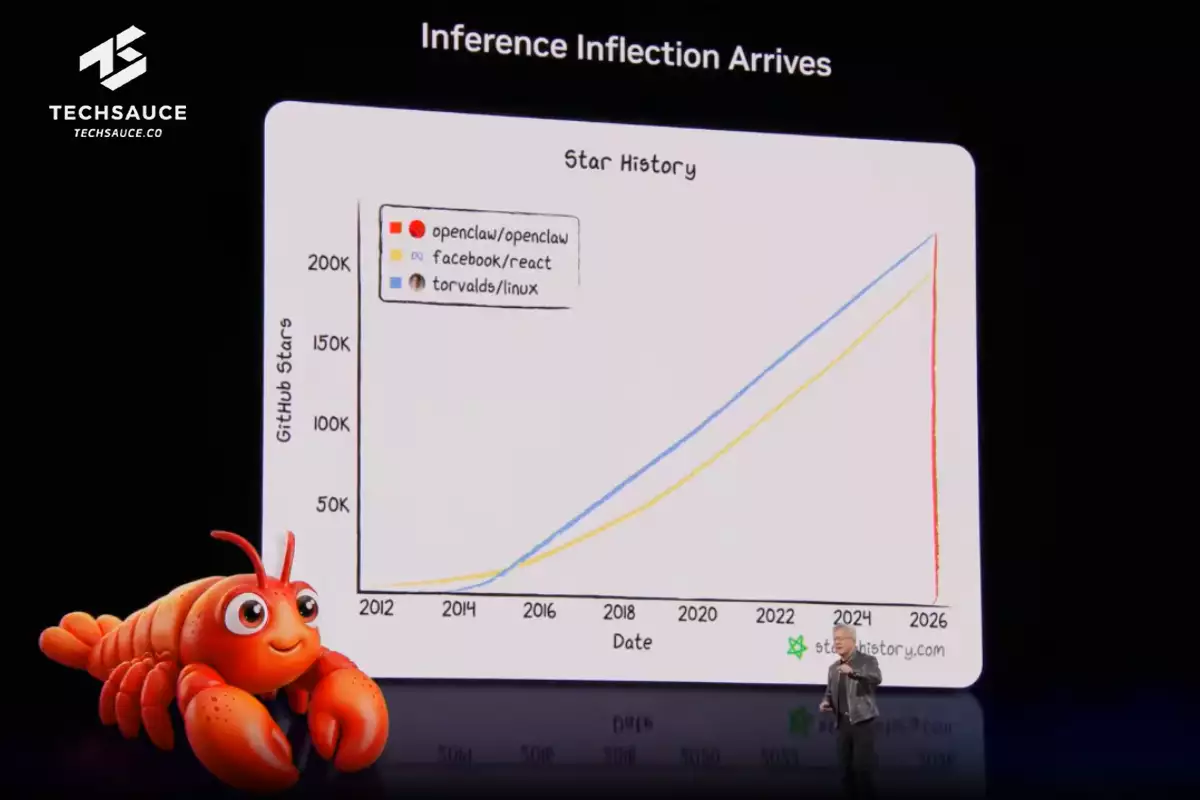

โดย OpenClaw เป็นโปรเจกต์โอเพนซอร์ส OpenClaw เริ่มต้นเมื่อวันที่ 20 พฤศจิกายน 2025 ด้วยยอดดาว (Star) บน GitHub 0 ดวง แต่กลับเติบโตอย่างก้าวกระโดดจนทำสถิติแซงหน้าโปรเจกต์ระดับตำนานอย่าง React, Linux, Kubernetes, PyTorch และอื่น ๆ

การนำไปใช้งานที่พุ่งสูงขึ้นอย่างรวดเร็วนี้เป็นสิ่งที่บ่งบอกชัดเจนว่า อุตสาหกรรมซอฟต์แวร์กำลังโหยหาและต้องการโครงสร้างพื้นฐานรูปแบบใหม่นี้ในเวลาที่เหมาะสมพอดี

OpenClaw คืออะไร ?

Jensen Huang นิยามว่า OpenClaw มีสถาปัตยกรรมและการทำงานที่เปรียบเสมือนระบบปฏิบัติการสำหรับคอมพิวเตอร์แบบเอเจนต์ โดยมีความสามารถหลักๆ ดังนี้

- เป็นระบบ Agentic ที่ทำหน้าที่เรียกใช้และเชื่อมต่อกับ Large Language Models

- สามารถเข้าถึงเครื่องมือ, จัดการทรัพยากร (Resources) และระบบไฟล์ได้ด้วยตัวเอง

- ทำงานอัตโนมัติ สามารถจัดตารางเวลาการทำงาน (Scheduling) และตั้งค่าให้ทำงานตามเวลาที่กำหนด (Cron Jobs)

- เมื่อได้รับคำสั่ง มันสามารถคิดวิเคราะห์และแยกแยะปัญหาออกเป็นขั้นตอนย่อย ๆ (Step-by-step) ได้

- สามารถสร้างเอเจนต์ย่อย ๆ และเรียกใช้งาน Sub-agents ตัวอื่นๆ ให้มาช่วยทำงานได้

- สามารถรับ Input และส่ง Output ได้ทุกรูปแบบ เช่น คุณสามารถพูดคุย โบกมือให้ ส่งข้อความ หรือใช้อีเมลสื่อสารกับมัน มันก็สามารถเข้าใจและตอบสนองได้

Jensen Huang เปรียบเทียบว่า Windows ทำให้เราสร้าง Personal Computer ได้ OpenClaw ทำให้เราสร้าง Personal Agents ได้ เขาบอกว่าทุกบริษัทต้องมี OpenClaw Strategy เหมือนที่เคยต้องมี Linux Strategy, HTTP/HTML Strategy, Kubernetes Strategy

เหตุผลสำคัญคือ โครงสร้างพื้นฐานด้าน IT แบบเดิมกำลังจะเปลี่ยนไป จากเดิมที่บริษัทซอฟต์แวร์ (SaaS) สร้างเครื่องมือให้พนักงานที่เป็นมนุษย์ใช้งาน ในอนาคตบริษัท SaaS ทุกแห่งจะเปลี่ยนผ่านกลายเป็นบริษัทให้บริการเอเจนต์แบบสำเร็จรูป หรือที่เรียกว่า Agent-as-a-Service

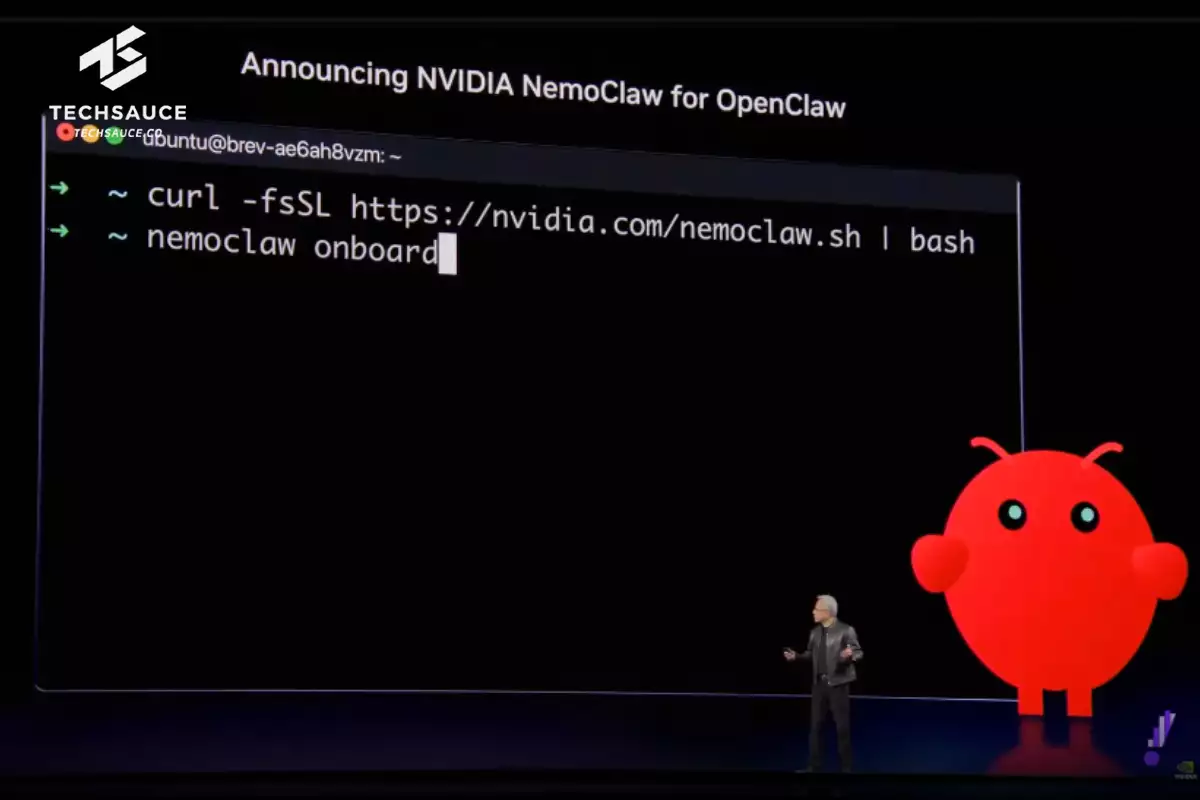

แต่การจะนำไปใช้ Openclaw ในระดับ Enterprise ยังมีเรื่องที่น่ากังวลอีกหลายอย่าง ด้วยความสามารถของ Openclaw ที่ขอสิทธิเข้าถึงได้หลายอย่าง เขาจึงนำเสนอสิ่งที่เรียกว่า NemoClaw ซึ่งเปรียบเสมือนเกราะป้องกันให้กับน้องกุ้ง Openclaw อีกชั้น

NemoClaw เกราะความปลอดภัยสำหรับ OpenClaw

แม้ OpenClaw จะเป็นเทคโนโลยีที่ทรงพลัง แต่ Jensen Huang ชี้ให้เห็นว่าสถาปัตยกรรมแบบ Agentic ระบบนี้มีความเสี่ยงที่องค์กรไม่สามารถยอมรับได้หากนำมาใช้โดยไม่มีการควบคุม

เพราะตัวระบบมีความสามารถในการเข้าถึงข้อมูลสำคัญ (เช่น ข้อมูลพนักงาน, ข้อมูลการเงิน, ซัพพลายเชน), สามารถรันและเอ็กซีคิวต์โค้ดได้ด้วยตัวเอง และที่สำคัญคือสามารถสื่อสารออกไปสู่โลกภายนอกได้

การปล่อยให้ AI ดึงข้อมูลความลับของบริษัทแล้วส่งออกไปภายนอกจึงเป็นสิ่งที่ยอมให้เกิดขึ้นไม่ได้เด็ดขาด

NVIDIA จึงทำงานร่วมกับ Peter Steinberger ผู้สร้าง OpenClaw เพื่อสร้าง NemoClaw - Reference Design สำหรับ OpenClaw ที่ปลอดภัยในระดับ Enterprise โดยมีองค์ประกอบสำคัญ 3 ส่วน ได้แก่

- OpenShell เป็นเทคโนโลยี Runtime ที่ถูกผสานเข้าไปใน OpenClaw เพื่อทำให้มันพร้อมสำหรับองค์กร โดยองค์กรสามารถเชื่อมต่อเข้ากับ Policy Engine ของบริษัทได้

- Network Guardrail และ Privacy Router ที่คอยปกป้องและควบคุมให้เอเจนต์ทำงานอยู่แค่ภายในเครือข่ายบริษัทอย่างปลอดภัย

- Nemotron 3 โมเดล Open Source ของ NVIDIA ที่ทำผลงานอยู่บนจุดสูงสุดของ Leaderboard และได้รับการจัดอันดับให้เป็น 1 ใน 3 โมเดลที่ดีที่สุดในโลก ทำให้องค์กรสามารถใช้งานโมเดลระดับแนวหน้าได้อย่างมั่นใจ

รวมพลังสร้าง Nemotron เพราะโมเดลจะเทพ ต้องร่วมกันสร้าง

NVIDIA ไม่ได้หยุดแค่การสร้างโมเดลด้วยตัวเอง แต่ได้ประกาศตั้งแนวร่วม Nemotron Coalition เพื่อผนึกกำลังในการพัฒนา Nemotron 4 ให้ทรงพลังยิ่งขึ้น โดยดึงพาร์ทเนอร์ระดับแนวหน้าในหลากหลายอุตสาหกรรมมาร่วมงาน เช่น

- Black Forest Labs (ด้านการสร้างภาพ)

- Cursor (บริษัทผู้สร้างเครื่องมือเขียนโค้ดชื่อดัง)

- LangChain (เฟรมเวิร์กสร้างเอเจนต์ที่มียอดดาวน์โหลดหลักพันล้านครั้ง)

- Mistral, Arthur, Perplexity (ระบบเอเจนต์แบบ Multi-modal ยอดฮิต)

- Reflection, Sarvam (สตาร์ทอัพจากอินเดีย)

- Thinking Machine (แล็ปของ Mira Murati)

ที่ต้องรวมตัวกันมากขนาดนี้ ก็เป็นเพราะเมื่อโลกเข้าสู่ยุคที่การทำงานถูกขับเคลื่อนด้วยเอเจนต์ Jensen Huang มองว่า วิศวกรและพนักงานบริษัทจะไม่ได้รับแค่เงินเดือนพื้นฐานเพียงอย่างเดียว แต่จะได้รับงบประมาณ Token ประจำปี เพื่อนำไปใช้เป็นพลังงานในการเรียกใช้งานเอเจนต์ให้มาช่วยทำงาน

ตัวอย่างเช่น หากพนักงานได้เงินเดือนหลักแสนดอลลาร์ บริษัทอาจให้งบ Token เพิ่มอีกครึ่งหนึ่งของเงินเดือน เพื่อใช้ป้อนให้เอเจนต์ช่วยเร่งผลผลิตของพนักงานคนนั้นให้เพิ่มขึ้นถึง 10 เท่า

การมีงบ Token ให้พนักงานจะกลายเป็นเครื่องมือสำคัญในการดึงดูดคนเก่งในซิลิคอนแวลลีย์ และคำถามที่ว่า "งานนี้มี Token ให้ใช้เท่าไหร่ ?" จะกลายเป็นเรื่องปกติในอนาคต

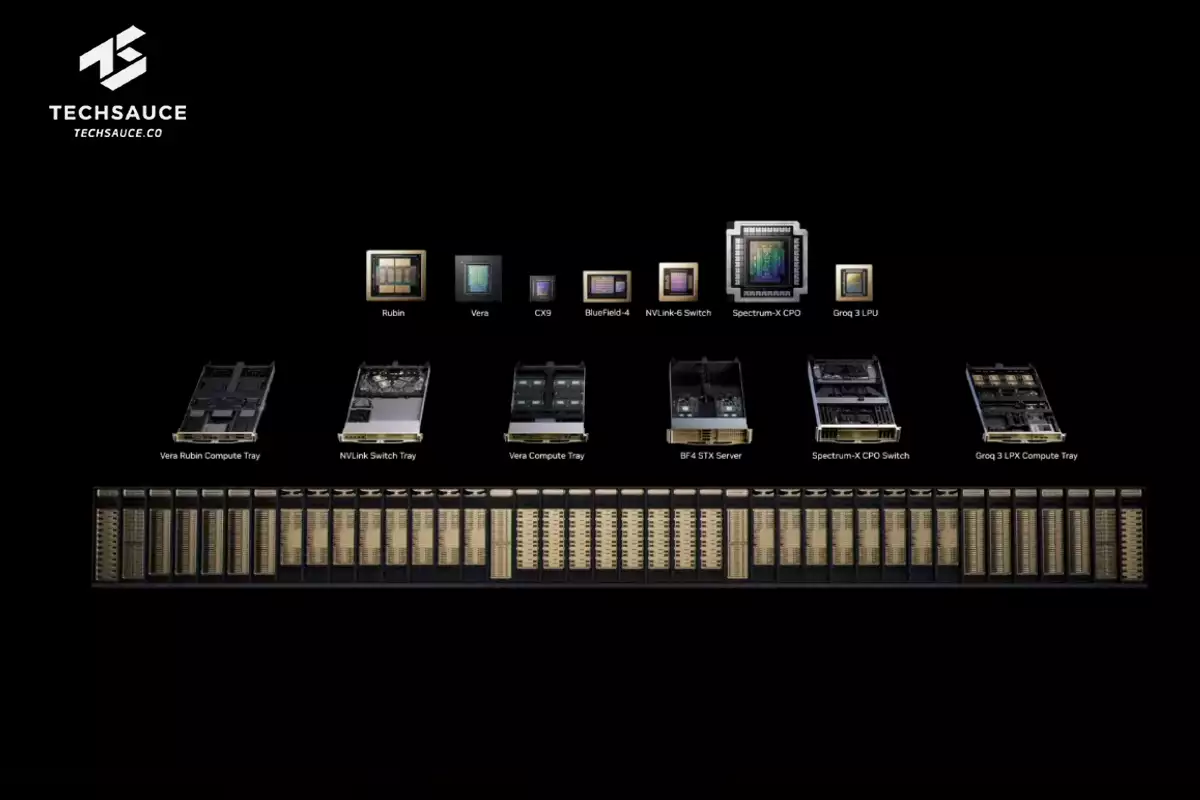

Vera Rubin และ Groq

อีกหนึ่งไฮไลต์ของงานนี้คือการประกาศเปิดตัว Vera Rubin สถาปัตยกรรมรุ่นต่อไป และการเข้าซื้อ Groq

Groq คืออะไร ?

เทคโนโลยีของ Groq มีความน่าสนใจมากเนื่องจากเป็นหน่วยประมวลผลแบบ Deterministic Data Flow Processor ที่ถูกออกแบบมาเพื่อการทำ Inference (การประมวลผลเพื่อสร้างคำตอบของ AI) โดยเฉพาะ

อย่างไรก็ตาม ปัญหาหลักของ Groq คือ มีหน่วยความจำน้อยมากเพียง 500 MB ต่อชิป เมื่อเทียบกับสถาปัตยกรรม Vera Rubin ที่มีมากถึง 288 GB ต่อชิป

ข้อจำกัดนี้ทำให้หากต้องการรองรับโมเดล AI ขนาดใหญ่ (เช่น ระดับล้านล้านพารามิเตอร์) จำเป็นต้องใช้ชิป Groq จำนวนมหาศาลมากเพื่อเก็บข้อมูลพารามิเตอร์และบริบทต่างๆ

เพื่อทลายข้อจำกัดนี้ NVIDIA ได้สร้างซอฟต์แวร์ระบบปฏิบัติการสำหรับ AI Factory ที่ชื่อว่า Dynamo เพื่อทำการแยกส่วนการประมวลผล โดยดึงเอาความโดดเด่นของทั้งสองสถาปัตยกรรมมาผสานกัน

- การเตรียมข้อมูลเบื้องต้น (Pre-fill) ซึ่งเป็นงานที่ต้องการ Throughput สูง จะถูกประมวลผลบน Vera Rubin

- การสร้างคำตอบ (Decode) ซึ่งต้องการความหน่วงต่ำ (Low latency) จะถูกส่งไปให้ Groq จัดการ

นอกจากนี้ ในกระบวนการ Decode ยังถูกแบ่งการทำงานย่อยอีก โดยส่วน Attention ที่ต้องใช้การคำนวณทางคณิตศาสตร์อย่างหนักจะทำบน Vera Rubin และส่วน Feed Forward Network (การสร้าง Token) จะทำบน Groq

ชิปทั้งสองระบบจะทำงานร่วมกันอย่างแนบเนียนผ่านการเชื่อมต่อเครือข่าย Ethernet ด้วยโหมดพิเศษที่ช่วยลดความหน่วงลงได้ถึงครึ่งหนึ่ง

ผลลัพธ์ที่ได้จากการทำงานร่วมกันนี้คือ ประสิทธิภาพการประมวลผลเพิ่มขึ้นถึง 35 เท่า และสร้างระดับความเร็วในการทำ Inference ใหม่ในแบบที่โลกไม่เคยเห็นมาก่อน

พาร์ทเนอร์ในการผลิต

- Samsung จะรับหน้าที่ผลิต Groq LP30 ให้ NVIDIA

- ชิปจะส่งมอบช่วง Q3

- ตู้เซิร์ฟเวอร์ Vera Rubin ตัวแรกได้ถูกติดตั้ง และเริ่มทำงานแล้วที่คลาวด์ของ Microsoft Azure

Roadmap ต่อไปของชิป NVIDIA

- Blackwell กำลังผลิตเต็มรูปแบบ

- Vera Rubin จะส่งมอบปีหน้า

- Rubin Ultra สถาปัตยกรรมรุ่นถัดไปที่จะมาพร้อมกับชิป LP35 ซึ่งเป็นครั้งแรกที่จะรองรับโครงสร้างการประมวลผลความแม่นยำระดับ NVFP4 เพื่อเพิ่มความเร็วขึ้นไปอีกขั้น

- Feynman สถาปัตยกรรมแห่งอนาคตที่จะมาพร้อม GPU รุ่นใหม่, ชิป LPU LP40, CPU รุ่นใหม่ชื่อ Rosa (ตั้งตามชื่อ Rosalind), ระบบเครือข่าย Bluefield 5 และ SuperNIC CX10

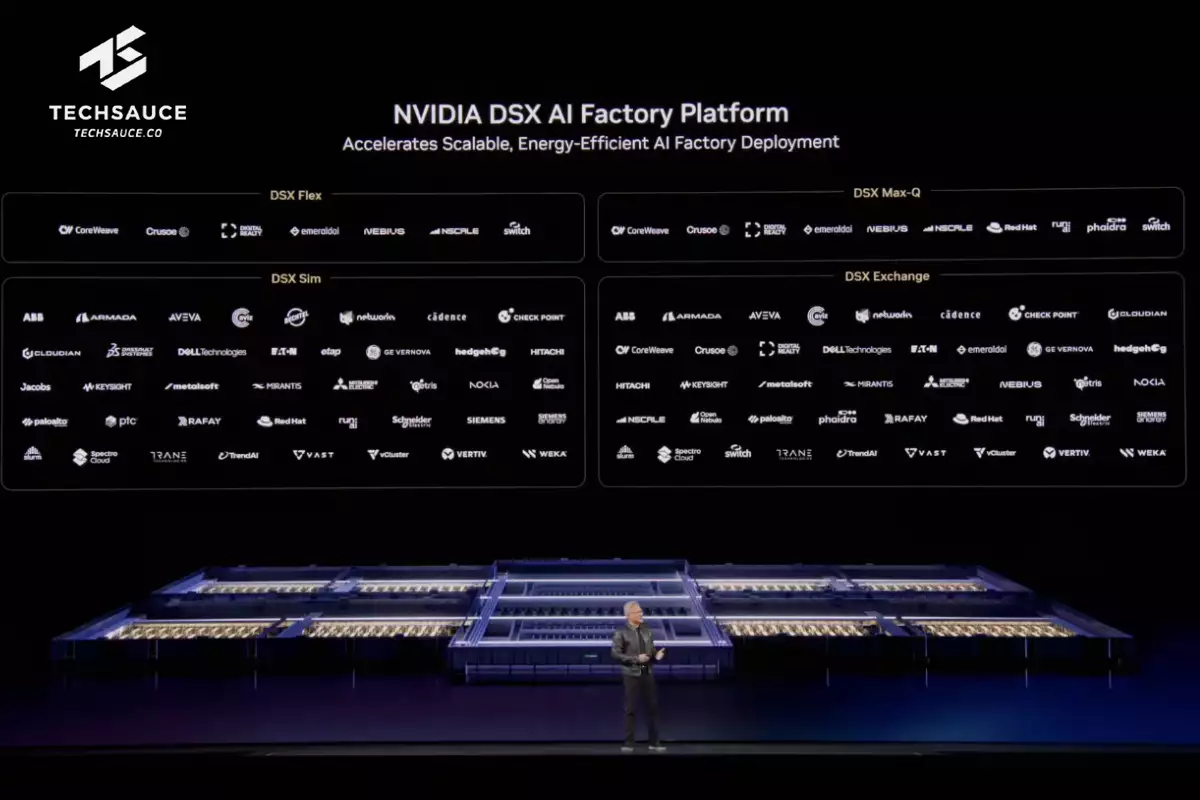

NVIDIA DSX โลกใหม่แห่งการ Simulation

การสร้าง AI Factory เป็นการสร้างระบบที่ซับซ้อนมหาศาลระดับกิกะวัตต์ (Gigawatt) Jensen Huang บอกว่า ปัญหาสำคัญที่พบคือ ชิ้นส่วนและอุปกรณ์จากแต่ละผู้ผลิตมักจะไม่เคยถูกนำมาประกอบหรือทดสอบร่วมกันเลย จนกระทั่งพวกมันถูกนำไปติดตั้งจริงใน Data Center

ซึ่งการไปพบปัญหาหน้างานนั้นทำให้เกิดความล่าช้า และความล่าช้าเพียงหนึ่งเดือนก็อาจหมายถึงการสูญเสียรายได้ระดับพันล้านดอลลาร์

เพื่อแก้ปัญหานี้ NVIDIA จึงสร้างโลกเสมือนบน Omniverse ที่ชื่อว่า NVIDIA DSX ซึ่งเป็น Digital Twin Blueprint ที่ให้ผู้ผลิตและผู้พัฒนาทุกฝ่ายสามารถนำอุปกรณ์ของตนมาพบเจอกันและทดสอบร่วมกันในโลกเสมือนก่อนที่จะสร้างจริง โดยประกอบไปด้วย API หลัก 4 ตัว ได้แก่

- DSX Sim สำหรับการจำลองระบบทั้งหมด ทั้งด้านกายภาพ, ระบบไฟฟ้า, ระบบระบายความร้อน และระบบเครือข่าย

- DSX Exchange สำหรับแลกเปลี่ยนและจัดการข้อมูลการดำเนินงานของ AI Factory

- DSX Flex สำหรับบริหารจัดการพลังงานแบบไดนามิกร่วมกับโครงข่ายไฟฟ้า (Grid) อย่างปลอดภัย

- DSX Max-Q ระบบที่คอยปรับแต่งการทำงานเพื่อรีดประสิทธิภาพการผลิต Token ให้ได้สูงสุด

NVIDIA ไม่ได้ทำระบบนี้เพียงลำพัง แต่ได้เปิดกว้างให้ซอฟต์แวร์ระดับโลกในแต่ละด้านเข้ามาทำงานร่วมกันเป็นทอด ๆ ประกอบไปด้วย

- PTC Windchill PLM ใช้สำหรับจัดการสินทรัพย์และอุปกรณ์ต่าง ๆ ที่พร้อมสำหรับการจำลอง

- Dassault Systèmes ดูแลการทำวิศวกรรมระบบตามแบบจำลอง (Model-based systems engineering)

- Jacobs นำข้อมูลทั้งหมดมาออกแบบต่อในแอปพลิเคชันบน Omniverse

- ทดสอบระบบระบายความร้อนภายนอกด้วย Siemens STAR-CCM+, ทดสอบระบบระบายความร้อนภายในด้วย Cadence Reality, ทดสอบระบบไฟฟ้าด้วย ETAP, และทดสอบเครือข่ายด้วย NVIDIA DSX Air

- Procore ใช้สำหรับการทดสอบการทดลองเดินเครื่องแบบเสมือนเพื่อให้มั่นใจว่าการก่อสร้างจริงจะรวดเร็วที่สุด

Jensen Huang เน้นย้ำว่า สำหรับ AI Factory นั้น "พลังงานที่สูญเปล่า คือรายได้ที่สูญเสียไป" (เพราะรายได้วัดจาก Token ที่ผลิตได้ต่อหน่วยวัตต์)

เป้าหมายหลักของการสร้าง DSX คือการบริหารจัดการอุปกรณ์ทุกชิ้นให้สัมพันธ์กัน ทั้งเรื่องการคำนวณ ไฟฟ้า และความร้อน เพื่อไม่ให้มีพลังงานใดถูกทิ้งไปอย่างสูญเปล่าเลย

ซึ่งเขาเชื่อมั่นว่าการบริหารจัดการแบบไดนามิกนี้ จะช่วยให้ AI Factory สามารถเพิ่ม Throughput หรือผลผลิตได้มากขึ้นอีกถึง 1 เท่าตัวภายใต้ข้อจำกัดด้านพลังงานที่มีอยู่เท่าเดิม

Physical AI ยุคของหุ่นยนต์ และรถยนต์ไร้คนขับ

Physical AI ตามความหมายของ Jensen Huang คือ AI ที่มีร่างกาย หรือที่เราเรียกกันว่า ‘หุ่นยนต์’ ซึ่ง NVIDIA ได้ซุ่มพัฒนาเทคโนโลยีในด้านนี้มานานถึงหนึ่งทศวรรษ โดยได้สร้างรากฐานสำคัญคือระบบคอมพิวเตอร์ 3 ประเภทที่จำเป็นสำหรับการสร้างหุ่นยนต์ ได้แก่

- Training Computer คอมพิวเตอร์สำหรับใช้ฝึกฝนโมเดล AI ของหุ่นยนต์

- Synthetic Data Generation and Simulation Computer คอมพิวเตอร์สำหรับสร้างข้อมูลสังเคราะห์และจำลองโลกเสมือนจริง เพื่อให้หุ่นยนต์ได้เรียนรู้ก่อนไปใช้ในโลกจริง

- Robotics Computer คอมพิวเตอร์ขนาดเล็กแต่ทรงพลังที่ฝังตัวอยู่ภายในหุ่นยนต์ โดยในงาน GTC ครั้งนี้ NVIDIA ได้แสดงให้เห็นถึงความยิ่งใหญ่ของ Physical AI โดยมีการนำหุ่นยนต์มาร่วมจัดแสดงมากถึง 110 ตัว

อีกหนึ่งสิ่งที่ NVIDIA พัฒนามาตลอดคือรถยนต์ไร้คนขับ ซึ่งในงานได้เปิดตัว Alpamayo ซึ่งเป็นโมเดลที่มอบความสามารถในการคิดวิเคราะห์และใช้เหตุผลให้กับรถยนต์ ส่งผลให้รถยนต์มีพฤติกรรมที่ฉลาดขึ้นอย่างก้าวกระโดด เช่น

- บรรยายการกระทำของตัวเองได้ เช่น "ฉันกำลังเปลี่ยนเลนไปทางขวาเพื่อไปตามเส้นทาง"

- อธิบายเหตุผลการตัดสินใจได้ เช่น "มีรถจอดซ้อนคันอยู่ในเลนของฉัน ฉันจึงต้องขับเบี่ยงหลบ"

- ตอบสนองคำสั่งเสียงของมนุษย์ได้ เช่น เมื่อมนุษย์สั่งให้เร่งความเร็ว รถจะตอบว่า "ได้เลย ฉันจะเร่งความเร็วเดี๋ยวนี้"

นอกจากนี้ NVIDIA ได้ประกาศขยาย Robo-Taxi Ready Platform โดยได้พันธมิตรผู้ผลิตรถยนต์หน้าใหม่ 4 ราย ได้แก่ BYD, Hyundai, Nissan และ Geely

เมื่อนำไปรวมกับพันธมิตรเดิมอย่าง Mercedes, Toyota และ GM จะทำให้มีรถยนต์ที่พร้อมรองรับระบบ Robo-Taxi เข้าสู่ตลาดมากถึง 18 ล้านคันต่อปี และยังได้ประกาศความร่วมมือครั้งใหญ่กับ Uber ในการเตรียมนำรถยนต์ Robo-Taxi เหล่านี้ไปให้บริการจริงในหลายเมืองอีกด้วย

อ้างอิง : NVIDIA GTC 2026 Keynote

ลงทะเบียนเข้าสู่ระบบ เพื่ออ่านบทความฟรีไม่จำกัด